Die ’Black Box’ der Modelle der künstlichen Intelligenz (KI) öffnen, um zu verstehen, wie die Ergebnisse zustande kommen und ob die Prognosen zuverlässig sind. Das ist der Vorschlag der "erklärbaren künstlichen Intelligenz". Dieser Zweig der KI hat sich in letzter Zeit bei Aufgaben der Computervision wie der Bilderkennung hervorgetan, bei denen es entscheidend darauf ankommt, die Entscheidungen des Modells zu verstehen. Aufgrund ihres Erfolgs wird sie nun auf verschiedene Bereiche ausgeweitet, in denen Vertrauen und Transparenz besonders wichtig sind, z. B. Gesundheitswesen, Transportwesen und Finanzwesen.

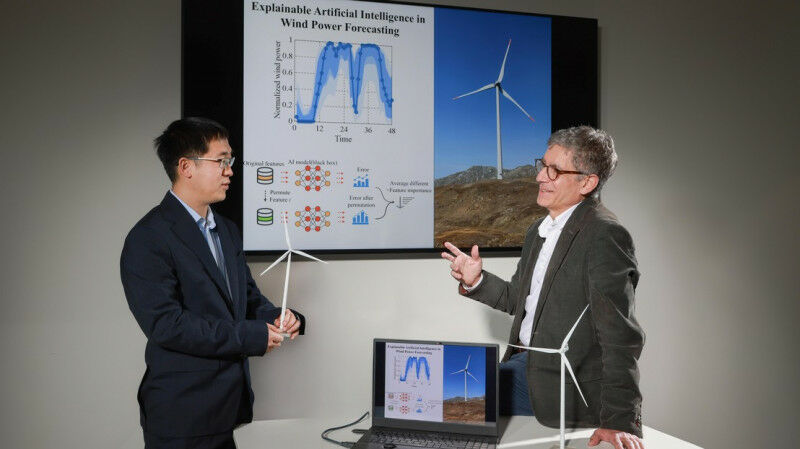

An der EPFL hat ein Team des Labors für Windenergietechnik und erneuerbare Energien (WiRE) die Methode angewendet, um die Blackbox der KI-Modelle in ihrem Bereich zu öffnen. Ihre Schlussfolgerung? Erklärbare KI verbessert die Interpretierbarkeit von Windenergieprognosen, da sie Zugang zur Entscheidungskette eines herkömmlichen KI-Modells bietet. Sie kann sogar dabei helfen, die wichtigsten Variablen zu identifizieren, die berücksichtigt werden müssen. Ihre Ergebnisse wurden kürzlich in der Zeitschrift Applied Energy veröffentlicht.

"Damit Netzbetreiber die Windenergie effektiv in ihre intelligenten Netze integrieren können, sind zuverlässige tägliche Prognosen ihrer Produktion mit einer geringen Fehlerquote unerlässlich", sagt Professor Fernando Porté-Agel, der an der Studie beteiligt ist. "Ungenaue Prognosen zwingen die Netzbetreiber dazu, in letzter Minute auszugleichen, oft durch den Einsatz von teurerer fossiler Energie."

Zuverlässigere Prognosen

Die Modelle, die derzeit zur Vorhersage der Windenergieproduktion verwendet werden, basieren auf Flüssigkeitsdynamik, Wettermodellierung und statistischen Methoden. Sie weisen immer eine nicht unerhebliche Fehlerquote auf. Mithilfe von KI konnten die Prognosen für die Windenergie verbessert werden, indem zahlreiche Daten genutzt wurden, um Muster zwischen den Variablen des Wettermodells und der Energieproduktion von Windkraftanlagen zu erkennen.Die meisten KI-Modelle funktionieren jedoch als "Black Boxes", was es schwierig macht, herauszufinden, wie sie zu bestimmten spezifischen Vorhersagen gelangen. Erklärbare KI löst dieses Problem, indem sie die Modellierungsprozesse, die zu den Prognosen führen, transparent macht, was zu glaubwürdigeren und zuverlässigeren Prognosen führt.

Wichtige Variablen identifizieren

In dieser Studie trainierte das Forschungsteam ein neuronales Netz, indem es Eingangsvariablen aus einem für die Windenergieerzeugung relevanten Wettermodell - mit Indikatoren wie Windrichtung und -geschwindigkeit, Luftdruck und Temperatur - sowie aus Daten, die in Windparks in der Schweiz und auf der ganzen Welt gesammelt wurden, auswählte. "Wir haben vier erklärbare KI-Techniken angepasst und Metriken entwickelt, um festzustellen, ob die Interpretation der Daten durch eine Technik zuverlässig ist", erklärt Wenlong Liao, Postdoktorand und Hauptautor der Studie.Im Bereich des maschinellen Lernens werden Metriken verwendet, um die Leistung des Modells zu bewerten. Beispielsweise können Metriken angeben, ob es sich bei der Beziehung zwischen zwei Variablen um Kausalität oder Korrelation handelt. Sie werden für bestimmte Anwendungen entwickelt - um eine Krankheit zu diagnostizieren, die Anzahl der durch Staus verlorenen Stunden zu messen oder die Börsenbewertung eines Unternehmens zu berechnen. "In unserer Studie haben wir mehrere Parameter definiert, um die Vertrauenswürdigkeit von erklärbaren KI-Techniken zu bewerten. Diese vertrauenswürdigen Techniken helfen uns zusätzlich dabei, die relevanten Variablen zu identifizieren, die wir in unseren Modellen berücksichtigen müssen, um zuverlässige Prognosen zu generieren", sagt Wenlong Liao. "Wir haben sogar festgestellt, dass wir bestimmte Variablen aus unseren Modellen ausschließen können, ohne dass diese dadurch weniger genau werden."