Combinando intelligenza artificiale e neuroscienze, un team dell’Università di Ginevra, Harvard e McGill ha rivelato il potenziale computazionale di un’area cerebrale al centro della motivazione.

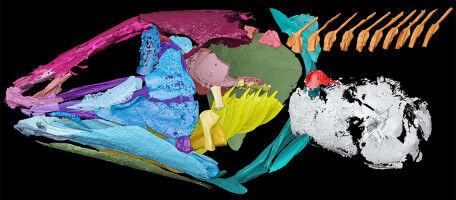

L’area tegmentale ventrale (VTA) svolge un ruolo fondamentale nella motivazione e nel circuito della ricompensa. Principale fonte di dopamina nel nostro cervello, questo piccolo nucleo di neuroni invia questo neuromodulatore ad altre regioni cerebrali per innescare un’azione in risposta a uno stimolo positivo.

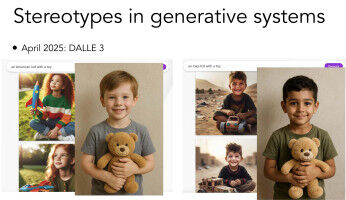

Questi risultati dimostrano che anche gli algoritmi possono diventare potenti indicatori dei nostri meccanismi neurofisiologici.

inizialmente si pensava che l’ATV fosse semplicemente il centro di ricompensa del cervello. Ma negli anni ’90 gli scienziati hanno scoperto che non codificava per la ricompensa in sé, ma per la previsione della ricompensa", spiega Alexandre Pouget, professore ordinario presso il Dipartimento di Neuroscienze Fondamentali della Facoltà di Medicina dell’Università di Ginevra.

Gli esperimenti condotti sugli animali hanno dimostrato che quando una ricompensa segue sistematicamente un segnale luminoso, ad esempio, l’ATV finisce per rilasciare dopamina non al momento della ricompensa, ma non appena il segnale appare. Questa risposta codifica quindi la previsione della ricompensa, associata al segnale luminoso, e non la ricompensa stessa.

Una funzione molto più sofisticata

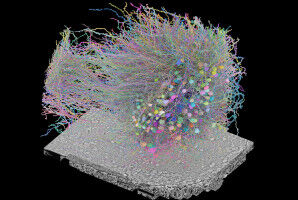

Questo "apprendimento per rinforzo", che richiede poca supervisione, è centrale negli esseri umani. È anche il principio su cui si basano gli algoritmi di intelligenza artificiale per ottimizzare i loro risultati nel corso delle sessioni di allenamento, come nel caso di Alpha Go, il primo algoritmo ad aver battuto il campione mondiale di Go.In un recente studio, il team di Alexandre Pouget, in collaborazione con Naoshige Uchida dell’Università di Harvard e Paul Masset dell’Università McGill, dimostra che la codifica dell’ATV è in realtà ancora più sofisticata di quanto si pensasse. invece di prevedere una somma ponderata di ricompense future, l’ATV ne prevede l’evoluzione temporale. In altre parole, ogni guadagno è rappresentato separatamente, con il momento preciso in cui è atteso", spiega Alexandre Pouget, che ha guidato questa ricerca.

mentre sapevamo che i neuroni dell’ATV davano la priorità alle ricompense vicine nel tempo rispetto a quelle più lontane - secondo il principio che un uccello nella mano vale due nel cespuglio - abbiamo scoperto che diversi neuroni dell’ATV davano la priorità alle ricompense vicine nel tempo rispetto a quelle più lontane - secondo il principio che un uccello nella mano vale due nel cespuglio.abbiamo scoperto che i diversi neuroni agiscono su scale temporali diverse: alcuni si concentrano sulla ricompensa possibile in pochi secondi, altri sulla ricompensa attesa in un minuto e altri ancora su orizzonti più lontani. È questa diversità che permette di codificare la cronologia della ricompensa.

Questa rappresentazione molto più fine conferisce al sistema di apprendimento una grande flessibilità, consentendogli di adattarsi per massimizzare le ricompense immediate o differite, a seconda degli obiettivi e delle priorità dell’individuo.

IA e neuroscienze: vasi comunicanti

Questi risultati sono il frutto di un dialogo tra neuroscienze e intelligenza artificiale. Alexandre Pouget ha progettato un algoritmo puramente matematico che tiene conto del fattore tempo nell’elaborazione della ricompensa. Da parte loro, i ricercatori di Harvard hanno raccolto una grande quantità di dati neurofisiologici sull’attività dell’ATV negli animali in situazione di ricompensa.hanno quindi applicato il nostro algoritmo ai loro dati e hanno scoperto che i risultati ottenuti corrispondevano perfettamente ai dati dei loro esperimenti empirici". Se il cervello ispira le tecniche di apprendimento automatico dell’intelligenza artificiale, questi risultati dimostrano che anche gli algoritmi possono diventare potenti indicatori dei nostri meccanismi neurofisiologici.

Questa ricerca è pubblicata su

Nature

DOI: 10.1038/s41586-025-08929-9