Wissenschaftler der EPFL haben in grossen KI-Modellen "Einheiten" entdeckt, die für die Sprache wesentlich zu sein scheinen und das Sprachsystem des Gehirns widerspiegeln. Wenn diese spezifischen Einheiten deaktiviert wurden, waren die Modelle bei sprachlichen Aufgaben deutlich weniger effizient

Grosse Sprachmodelle (LLM) sind nicht nur leistungsstark beim Verstehen und Verwenden von Sprache, sie können auch logisch argumentieren oder denken und Probleme lösen. Einige von ihnen können sogar die Gedanken, Überzeugungen oder Emotionen der Menschen, mit denen sie interagieren, vorhersagen.

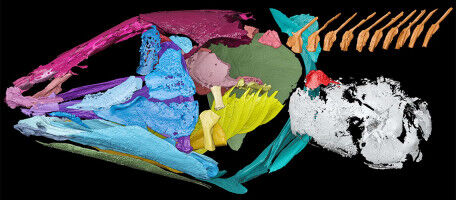

Trotz dieser beeindruckenden Leistungen verstehen wir immer noch nicht ganz, wie LLMs funktionieren, insbesondere wenn es darum geht, wie verschiedene Module oder Einheiten unterschiedliche Aufgaben erfüllen. So wollten die Forscherinnen und Forscher des NeuroAI-Labors, das sowohl zur Fakultät für Informatik und Kommunikation (IC) als auch zur Fakultät für Biowissenschaften (SV) gehört, sowie des Labors für die Verarbeitung natürlicher Sprache (IC) herausfinden, ob es in LLMs Einheiten oder Module gibt, die sich auf bestimmte Aufgaben spezialisiert haben. Dies orientiert sich an Netzwerken, die im menschlichen Gehirn entdeckt wurden, wie dem Sprachnetzwerk , dem Multiple-Request-Netzwerk und dem Netzwerk für die Theorie des Geistes.

In einem diesen Monat auf der 2025 Annual Conference of the Nations of the Americas Chapter of the Association for Computational Linguistics , in Albuquerque, USA, vorgestellten Bericht erläutern die Forscherinnen und Forscher, wie sie 18 beliebte LLMs untersucht und festgestellt haben, dass einige Einheiten tatsächlich ein zentrales sprachorientiertes Netzwerk zu bilden scheinen.

"In Anlehnung an Ansätze aus den Neurowissenschaften, die die funktionale Organisation unseres Gehirns kartographiert haben, verglichen wir die Aktivität einer Einheit beim Lesen von echten Sätzen mit der Aktivität beim Lesen von zufälligen Wortlisten. Die Einheiten, die am aktivsten auf reale Sätze reagierten, wurden dann als "sprachselektive Einheiten" identifiziert, genau wie das Sprachnetzwerk in unserem Gehirn", erklärt Assistenzprofessor Martin Schrimpf, Leiter des NeuroAI-Labors

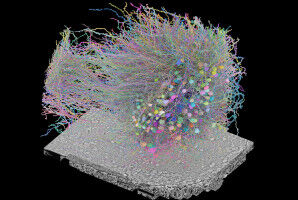

Weniger als 100 wirklich relevante Neuronen

Um die kausale Rolle der von ihnen identifizierten sprachselektiven Einheiten zu überprüfen, löschten die Wissenschaftler diese Einheiten und entfernten getrennt voneinander verschiedene Sätze von zufälligen Einheiten. Dann verglichen sie die Unterschiede in dem, was als Nächstes geschah. Wenn die sprachselektiven Einheiten entfernt wurden - nicht aber die zufälligen Einheiten -, waren die Modelle nicht mehr in der Lage, einen zusammenhängenden Text zu produzieren und konnten bei den sprachlichen Markern keine guten Ergebnisse erzielen.

"Die Ergebnisse zeigen, dass diese Einheiten für das Modell wirklich wichtig sind. Die grösste Überraschung für uns ist, dass es wahrscheinlich weniger als 100 Neuronen - etwa 1% der Einheiten - gibt, die für alles, was die Fähigkeit eines Modells, Sprache zu produzieren und zu verstehen, betrifft, äusserst relevant zu sein scheinen, und wenn sie gestört sind, versagt das Modell plötzlich völlig", erklärt Badr AlKhamissi, Doktorassistent an den NeuroAI- und NLP-Laboratorien und Hauptautor des Artikels.

"Es gibt Forschungsarbeiten zum maschinellen Lernen und zur Interpretierbarkeit, bei denen bestimmte Netzwerke oder Einheiten in einem für die Sprache relevanten Modell identifiziert werden konnten. Aber das erforderte viel Übung und war viel komplizierter, als denselben Lokalisierer wie in der menschlichen Neurowissenschaft zu verwenden. Wir hatten nicht wirklich erwartet, dass es so gut funktionieren würde", fährt er fort.

Neben den selektiven Spracheinheiten warf dies eine weitere Frage auf: Könnten die gleichen Lokalisierer, die zur Identifizierung anderer Gehirnnetzwerke wie des Theory of Mind-Netzwerks und des Multiple Request-Netzwerks entwickelt wurden, auch auf LLM angewendet werden?

Mithilfe dieser Lokatoren versuchten die Teams der EPFL zu ermitteln, ob andere Einheiten in den Modellen auf logisches oder soziales Denken spezialisiert sind. Sie stellten fest, dass einige Modelle über diese spezifischen Aufgabeneinheiten verfügten, andere hingegen nicht

Forschung jenseits der Sprache

"In einigen Modellen fanden wir Einheiten, die auf logisches Denken und soziale Aufgaben spezialisiert waren, in anderen hingegen nicht. Die interessante Frage ist nun, woher das kommt? Warum haben einige Modelle diese Präferenz? Hat das etwas mit ihrer Leistung bei verwandten Benchmarks zu tun? Wenn Sie etwas isolierte Einheiten haben, kann das Modell dann besser abschneiden? Das könnte damit zusammenhängen, wie die Modelle trainiert werden oder mit welchen Daten sie trainiert werden, und das ist ein Ansatzpunkt für weitere Forschung", sagt Martin Schrimpf.

Weitere zukünftige Forschungen werden sich damit befassen, was in multiplen Modellen passiert - Modellen, die nicht nur auf Text trainiert werden, sondern auch viele andere Informationsmodalitäten verarbeiten können, einschliesslich Bilder, Video und Ton.

"Das interessiert mich wirklich sehr, denn als Menschen funktionieren wir auf der Grundlage von Sprache und visuellen Daten. Wenn wir nun ein multimodales Modell verwenden und ihm zum Beispiel Sprache als visuelle Daten geben, wie Menschen, die einen Text lesen, wird er dann die gleichen sprachlichen Defizite haben, wie wenn wir das Sprachnetzwerk in der LLM im Vergleich zu einer visuellen Aufgabe, bei der er verschiedene Objekte identifizieren oder mathematische Überlegungen anstellen muss, entfernt haben? Werden diese intakt bleiben?", fragt Badr AlKhamissi.

Insgesamt sind die Wissenschaftler der Ansicht, dass diese Studien dazu beitragen, das Rätsel zu lösen, wie die grossen Sprachmodelle funktionieren, indem sie sich auf die Neurowissenschaften berufen und Verbindungen zur Funktionsweise des menschlichen Gehirns herstellen.

"Wenn man an die Schädigung des Sprachnetzwerks im Gehirn von Menschen denkt, die einen Schlaganfall erlitten haben, kommt es häufig vor, dass sie unter schweren Sprachstörungen leiden, während alles andere intakt ist. Es ist hier sehr ähnlich mit der sprachlichen Komponente des LLM, die nur Kauderwelsch produziert, und obwohl wir das nicht getestet haben, könnte es wahrscheinlich bei allem anderen noch gut funktionieren. Wir hoffen, dass diese Modelle uns helfen werden, uns selbst und unser Gehirn besser zu verstehen, was wiederum den Weg für eine bessere Diagnose und Behandlung von Krankheiten ebnet", schliesst Martin Schrimpf.

Das NeuroAI-Labor ist Teil des Neuro-X-Instituts der EPFL, einer kollaborativen und interdisziplinären Gemeinschaft, die Teams aus der Fakultät für Informatik und Kommunikation, der Fakultät für Biowissenschaften und der Fakultät für Ingenieurwissenschaften und -techniken der EPFL vereint .