Gli scienziati dell’EPFL hanno scoperto "unità" in grandi modelli di intelligenza artificiale che sembrano essenziali per il linguaggio, riflettendo il sistema linguistico del cervello. Quando queste unità specifiche venivano disattivate, i modelli risultavano significativamente meno efficaci nei compiti linguistici

I modelli linguistici di grandi dimensioni (LLM) non sono solo in grado di comprendere e utilizzare il linguaggio, ma anche di ragionare o pensare in modo logico e risolvere problemi. Alcuni di essi possono persino prevedere i pensieri, le convinzioni o le emozioni delle persone con cui interagiscono.

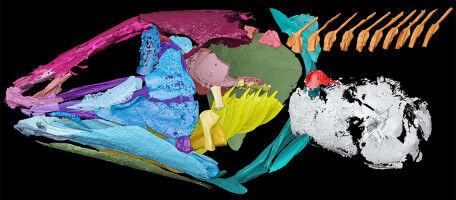

Nonostante queste impressionanti prodezze, non abbiamo ancora compreso appieno il funzionamento delle LLM, soprattutto per quanto riguarda il modo in cui i diversi moduli o unità svolgono i diversi compiti. I ricercatori del laboratorio NeuroAI, che fa parte della Facoltà di Informatica e Comunicazione (IC) e della Facoltà di Scienze della Vita (SV), nonché del Laboratorio di Elaborazione del Linguaggio Naturale (IC), hanno voluto scoprire se le LLM hanno unità o moduli specializzati per compiti specifici. Lo studio si ispira alle reti scoperte nel cervello umano, come la rete del linguaggio, la rete delle richieste multiple e la rete della teoria della mente.

In un articolo presentato questo mese alla 2025 Conferenza annuale delle Nazioni del Capitolo delle Americhe dell’Associazione per la Linguistica Computazionale, ad Albuquerque (USA), i ricercatori spiegano come hanno studiato 18 LLM popolari e hanno scoperto che alcune unità sembrano effettivamente costituire una rete centrale orientata al linguaggio.

"Attingendo agli approcci delle neuroscienze, che hanno mappato l’organizzazione funzionale del nostro cervello, abbiamo confrontato l’attività di un’unità durante la lettura di frasi reali rispetto alla lettura di liste di parole casuali. Le unità che reagivano più attivamente alle frasi reali sono state identificate come ’unità linguistiche selettive’, proprio come la rete linguistica del nostro cervello", spiega il professore assistente Martin Schrimpf, responsabile del laboratorio NeuroAI

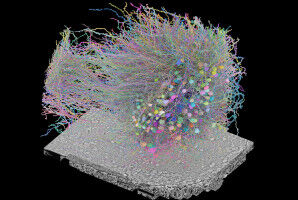

Meno di 100 neuroni veramente rilevanti

Per verificare il ruolo causale delle unità linguistiche selettive identificate, gli scienziati hanno rimosso queste unità e, separatamente, diversi gruppi di unità casuali. Poi hanno confrontato le differenze in ciò che accadeva dopo. Quando le unità linguistiche selettive sono state rimosse - ma non le unità casuali - i modelli non sono più stati in grado di produrre testi coerenti e non sono stati in grado di rispondere bene alle indicazioni linguistiche.

"I risultati mostrano che queste unità sono davvero importanti per il modello. La sorpresa principale per noi è che ci sono probabilmente meno di 100 neuroni - circa l’1% delle unità - che sembrano essere estremamente rilevanti per tutto ciò che ha a che fare con la capacità di un modello di produrre e comprendere il linguaggio e, quando vengono interrotti, il modello improvvisamente fallisce completamente", spiega Badr AlKhamissi, assistente di dottorato presso i laboratori NeuroAI e NLP, e autore principale dell’articolo.

"Esistono ricerche sull’apprendimento automatico e sull’interpretabilità che hanno identificato determinate reti o unità in un modello rilevante per il linguaggio. Ma questo richiedeva una grande quantità di addestramento ed era molto più complicato che usare lo stesso localizzatore delle neuroscienze umane. Non ci aspettavamo che funzionasse così bene", continua.

Oltre alle unità linguistiche selettive, ciò ha sollevato un’altra questione: gli stessi localizzatori progettati per identificare altre reti cerebrali, come la rete della teoria della mente e la rete delle richieste multiple, potrebbero essere applicati anche alle LLM?

Utilizzando questi localizzatori, i team dell’EPFL hanno cercato di valutare se altre unità nei modelli fossero specializzate nel ragionamento o nel pensiero sociale. Hanno scoperto che alcuni modelli presentavano queste unità di compito specifiche, mentre altri non le avevano

Ricerca oltre il linguaggio

"In alcuni modelli abbiamo trovato unità specializzate nel ragionamento e nel pensiero, ma non in altri. Ora la domanda interessante è: da dove viene questo? Perché alcuni modelli hanno questa preferenza? Ha a che fare con le loro prestazioni su benchmark correlati? Se avete unità leggermente isolate, questo permette al modello di fare meglio? Questo potrebbe essere legato al modo in cui i modelli vengono addestrati o ai dati su cui vengono addestrati, ed è una strada da percorrere per ulteriori ricerche", afferma Martin Schrimpf.

Ulteriori ricerche saranno condotte per capire cosa succede nei modelli multipli - modelli che non sono addestrati solo sul testo, ma possono anche elaborare molte altre modalità di informazione, tra cui immagini, video e suoni.

"Questo mi interessa molto, perché come esseri umani lavoriamo su dati vocali e visivi. Ora, se usiamo un modello multimodale e gli diamo, per esempio, il linguaggio come input visivo, proprio come le persone che leggono un testo, avrà gli stessi deficit linguistici di quando abbiamo rimosso la rete linguistica nei LLM in relazione a un compito visivo in cui deve identificare diversi oggetti o intraprendere un ragionamento matematico? Rimarranno intatti?", si chiede Badr AlKhamissi.

In generale, gli scienziati ritengono che questi studi stiano contribuendo a risolvere l’enigma del funzionamento interno dei principali modelli linguistici, facendo riferimento alle neuroscienze e stabilendo collegamenti con il funzionamento del cervello umano.

"Se pensiamo ai danni alla rete linguistica nel cervello delle persone che hanno avuto un ictus, spesso soffrono di gravi disturbi del linguaggio, mentre tutto il resto è intatto. È molto simile alla componente linguistica del LLM, che produce solo parole senza senso e, sebbene non l’abbiamo testato, probabilmente potrebbe ancora funzionare bene su tutto il resto. Speriamo che questi modelli ci aiutino a capire meglio noi stessi e il nostro cervello, aprendo così la strada a una migliore diagnosi e al trattamento delle malattie", conclude Martin Schrimpf.

Il laboratorio NeuroAI fa parte dell’ Istituto Neuro-X dell’EPFL, una comunità collaborativa e interdisciplinare che riunisce team della Scuola di Informatica e Comunicazione, della Scuola di Scienze della Vita e della Scuola di Ingegneria dell’EPFL .