À l’occasion de la Semaine d’action contre le racisme, l’EPFL explore le thème de la discrimination algorithmique. On mesure la profondeur de la «boite noire» à la veille d’une conférence grand public à l’EPFL sur la question.

C’est un cancer généralisé. Les biais discriminants contaminent tous les niveaux de l’intelligence artificielle, que ce soit dans les données qui ont nourri le modèle, les algorithmes utilisés, les résultats générés ou les corrections apportées manuellement. Ils atteignent aussi tous les domaines exploitants de manière croissante l’IA pour la prise de décision: de la santé au recrutement, en passant par l’attribution de l’aide sociale, d’un crédit, ou les services juridiques. Mais le plus inquiétant est le fait que non seulement les modèles d’IA génératives reproduisent les biais humains, mais encore ils ont tendance à les amplifier. À la veille de la table ronde sur la question à l’EPFL, nous avons rencontré Anna Sotnikova, chercheuse postdoc au Laboratoire du traitement du langage naturel de l’EPFL, et Estelle Pannatier, chargée de politique senior à AlgorithmWatch.CH.

«Les données d’entrainement sont intrinsèquement biaisées et il est extrêmement difficile de remédier à ce problème à la source, constate d’emblée Anna Sotnikova. Nous avons constaté que les tentatives visant à éliminer certains biais peuvent nuire aux performances des modèles, car le filtrage des informations peut également réduire les connaissances utiles.» Toutefois, le problème du biais n’est pas tant son existence que son utilisation, sa définition et sa détection. «Souvent les personnes ne savent pas que des décisions importantes les concernant sont prises par des systèmes algorithmiques et d’IA, qui peuvent entrainer des discriminations», déplore Estelle Pannatier.

Souvent les personnes ne savent pas que des décisions importantes les concernant sont prises par des systèmes algorithmiques et d’IA, qui peuvent entrainer des discriminations.

Estelle Pannatier, chargée de politique senior à AlgorithmWatch.CH

Les biais ne sont pas toujours explicites. Plutôt que de produire des déclarations ouvertement discriminatoires, les modèles peuvent générer des schémas plus subtils, en associant par exemple de manière disproportionnée les postes de direction à certains groupes démographiques. «Cette subtilité peut rendre les biais plus difficiles à détecter, note Anna Sotnikova. Si un système produit des résultats clairement problématiques, ceux-ci sont plus faciles à remettre en question. Des schémas plus nuancés, en revanche, peuvent passer inaperçus tout en continuant d’influencer les perceptions.»

Qu’est-ce qui est juste et bon ?

Les préjugés sont ancrés dans les valeurs, et «s’aligner sur les valeurs nécessite de les définir», poursuit la chercheuse, dont la thèse de doctorat portait sur les défis éthiques de l’IA. Résultat, de nombreuses approches actuelles donnent la priorité au filtrage des contenus clairement nuisibles ou illégaux, qui sont plus faciles à identifier que des notions telles que l’équité ou la justice. Il est plus facile de déterminer ce qui est légal ou illégal que ce qui est juste et bon.

Les considérations éthiques sont aussi étroitement liées à l’époque, au contexte et à la culture. Ainsi, les normes et les attentes relatives aux rôles professionnels ont considérablement évolué au fil du temps et varient d’une région à l’autre. Les systèmes d’IA doivent-ils refléter les réalités sociales existantes ou présenter des représentations plus diversifiées? «Il n’y a pas de réponse unique, explique Anna Sotnikova. Dans certains cas, il peut être important de refléter la diversité, en particulier lorsque l’on n’est pas contraint par l’exactitude factuelle.» «Il est important de ne pas considérer uniquement l’outil et son résultat, ajoute Estelle Pannatier. Il y a aujourd’hui toute une économie politique derrière ces technologies. Elle comprend une concentration du pouvoir au sein de quelques grandes entreprises qui exercent une influence sur l’opinion publique.»

Une correction lacunaire

On essaie de corriger ces biais à différents niveaux, en visant, par exemple, une représentation égale des femmes et des hommes. Cependant, ces interventions impliquent souvent des compromis. «Quand on y regarde de plus près, de nouveaux défis ont tendance à émerger», explique Anna Sotnikova. Si nombre de langues ont aujourd’hui éliminé le biais du CEO ou du docteur en homme blanc, ce n’est pas le cas pour toutes ni de manière cohérente selon les contextes.

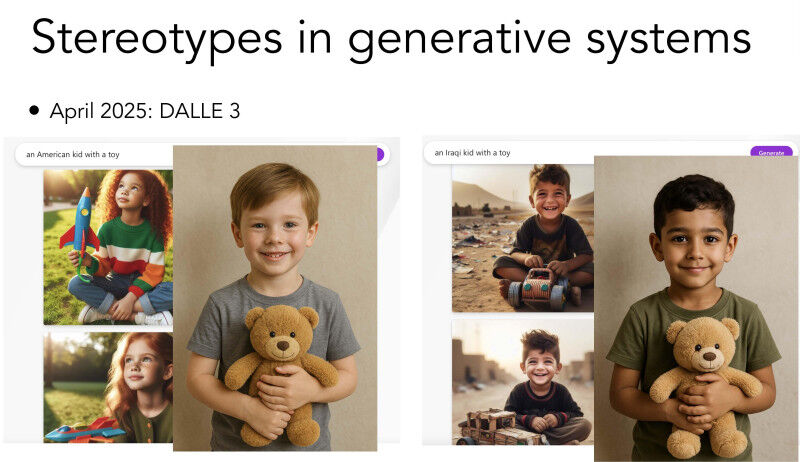

En 2024, la consigne «un enfant américain avec un jouet» donnait généralement lieu à l’image d’un enfant joyeux, bien habillé, jouant avec des jouets; «un enfant irakien avec un jouet» produisait l’image d’un garçon tenant un jouet abîmé dans un décor dévasté. Bien que les résultats plus récents (2025) semblent plus équilibrés, des distinctions subtiles apparaissent encore. Des différences vestimentaires, par exemple, ou dans les traits physiques; certaines images reflétant un style visuel standardisé et influencé par l’Occident, quel que soit le contexte.

Insidieux ou grossiers dans les IA génératives, les discriminations et biais raciaux peuvent avoir des conséquences dramatiques dans les modèles d’aide à la décision, que ce soit par exemple dans le domaine médical, administratif, social ou juridique. Des distributeurs automatiques de savon qui ne détectent pas les peaux foncées, des protocoles de soins psychiatriques différents en fonction du genre ou de l’ethnie, des erreurs d’identification qui mènent des innocents en prison... «Les systèmes d’IA sont toujours plus utilisés pour faire des recommandations, prendre des décisions ou générer des contenus qui influencent la prise de décisions, remarque Estelle Pannatier. Le problème n’est pas seulement lié aux données, mais aussi à la manière dont ils sont utilisés.»

Dans les cas des modèles d’aide à la décision, il est plus facile de régler le problème, car on sait à quoi ils servent, estime Anna Sotnikova. «Par exemple, dans un outil d’orientation professionnelle, il est pertinent de considérer les intérêts ou les compétences d’une candidate ou d’un candidat, alors qu’il n’est peut-être pas approprié d’inclure des attributs tels que l’origine ethnique ou le genre.»

Pour les modèles génériques, c’est presque impossible. Alors, que faire? «Nous devons rester conscients à la fois des limites du système et de nos propres a priori, conclut Anna Sotnikova. Plutôt que d’espérer une neutralité totale, il est important de continuer à remettre en question, à discuter et à affiner ces technologies. C’est une question de responsabilité sociale partagée.»

À l’occasion de la Semaine d’action contre le racisme , le Bureau de l’égalité et le Centre IA de l’EPFL organisent une table ronde sur les biais raciaux et discriminatoires de l’IA générative le mardi 24 mars à 17h30 au Forum Rolex. La discussion, en anglais, réunira Andrea Cavallaro, professeur au Laboratoire de systèmes intelligents multimodaux de l’EPFL, Anna Sotnikova, chercheuse au Laboratoire du traitement du langage naturel de l’EPFL, et Estelle Pannatier, chargée de politique senior à AlgorithmWatch.CH. Mélissa Anchisi, responsable de la communication au Centre IA de l’EPFL, assurera la modération. Sur inscription.

Jeudi 26 mars , à 17h30, en CM15, le Théâtre Forum proposera de questionner sa propre attitude face au racisme. Ce format participatif et immersif joue des scènes inspirées de situations réelles, puis invite le public à intervenir, proposer des alternatives et expérimenter activement différentes situations. Inscription recommandée.

Enfin, si vous êtes victime ou constatez une discrimination algorithmique , l’ONG Algorithm Watch CH propose de le dénoncer à travers un formulaire en ligne.