Nell’ambito della Settimana d’azione contro il razzismo, l’EPFL sta esplorando il tema della discriminazione algoritmica. Diamo uno sguardo alle profondità della "scatola nera" alla vigilia di una conferenza pubblica sul tema all’EPFL.

È un cancro diffuso. I pregiudizi discriminatori contaminano tutti i livelli dell’intelligenza artificiale, sia nei dati che alimentano il modello, sia negli algoritmi utilizzati, sia nei risultati generati o nelle correzioni effettuate manualmente. Inoltre, stanno influenzando tutti i settori in cui l’intelligenza artificiale viene sempre più utilizzata per prendere decisioni: dall’assistenza sanitaria alle assunzioni, senza dimenticare l’assegnazione di prestazioni sociali, il credito o i servizi legali. Ma l’aspetto più preoccupante è che i modelli generativi di IA non solo riproducono i pregiudizi umani, ma tendono ad amplificarli. Alla vigilia della tavola rotonda sul tema all’EPFL, abbiamo parlato con Anna Sotnikova, ricercatrice postdoc presso il Natural Language Processing Laboratory dell’EPFL, ed Estelle Pannatier, senior policy officer di AlgorithmWatch.CH.

i dati di addestramento sono intrinsecamente parziali ed è estremamente difficile rimediare a questo problema alla fonte", afferma Anna Sotnikova fin dall’inizio. Abbiamo scoperto che i tentativi di eliminare alcuni pregiudizi possono essere dannosi per le prestazioni del modello, poiché il filtraggio delle informazioni può anche ridurre le conoscenze utili" Tuttavia, il problema dei pregiudizi non è tanto la loro esistenza quanto il loro uso, la loro definizione e la loro individuazione. "Le persone spesso non sono consapevoli del fatto che le decisioni importanti che le riguardano sono prese da sistemi algoritmici e di intelligenza artificiale, il che può portare alla discriminazione", deplora Estelle Pannatier.

Le persone spesso non sono consapevoli del fatto che le decisioni importanti che le riguardano sono prese da sistemi algoritmici e di IA, il che può portare alla discriminazione.

Estelle Pannatier, senior policy officer di AlgorithmWatch.CH

I pregiudizi non sono sempre espliciti. Piuttosto che produrre dichiarazioni apertamente discriminatorie, i modelli possono generare modelli più sottili, ad esempio associando in modo sproporzionato le posizioni dirigenziali a determinati gruppi demografici. "Questa sottigliezza può rendere i pregiudizi più difficili da individuare", osserva Anna Sotnikova. Se un sistema produce risultati chiaramente problematici, è più facile metterli in discussione. Modelli più sfumati, invece, possono passare inosservati pur continuando a influenzare le percezioni"

Cosa è giusto e buono?

I pregiudizi sono radicati nei valori e "per allinearsi ai valori è necessario definirli", continua il ricercatore, la cui tesi di dottorato si è concentrata sulle sfide etiche dell’IA. Di conseguenza, molti approcci attuali danno la priorità al filtraggio dei contenuti chiaramente dannosi o illegali, che sono più facili da identificare rispetto a nozioni come l’equità o la giustizia. È più facile determinare ciò che è legale o illegale rispetto a ciò che è giusto e buono.

Le considerazioni etiche sono anche strettamente legate al tempo, al contesto e alla cultura. Ad esempio, gli standard e le aspettative dei ruoli professionali sono cambiati notevolmente nel tempo e variano da regione a regione. I sistemi di IA dovrebbero riflettere le realtà sociali esistenti o presentare rappresentazioni più diversificate? "Non esiste una risposta univoca", spiega Anna Sotnikova. In alcuni casi, può essere importante riflettere la diversità, soprattutto quando non si è vincolati dall’accuratezza dei fatti" "È importante non considerare solo lo strumento e il suo risultato", aggiunge Estelle Pannatier. Ora c’è un’intera economia politica dietro queste tecnologie. Comprende una concentrazione di potere all’interno di poche grandi aziende che esercitano un’influenza sull’opinione pubblica"

Una correzione incompleta

Si cerca di correggere questi pregiudizi a vari livelli, ad esempio puntando a una rappresentanza paritaria di uomini e donne. Tuttavia, questi interventi comportano spesso dei compromessi. "Quando si guarda più da vicino, tendono a emergere nuove sfide", spiega Anna Sotnikova. Sebbene molte lingue abbiano eliminato il pregiudizio nei confronti dell’amministratore delegato o del medico maschio bianco, non è così per tutti, né è coerente tra i vari contesti.

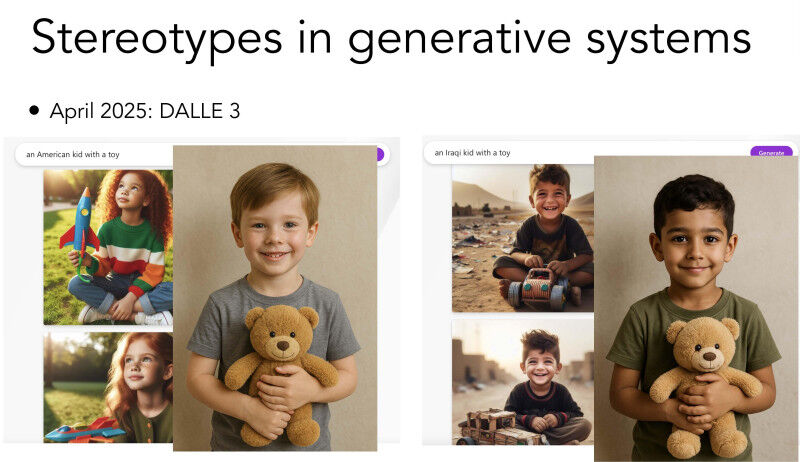

Nel 2024, l’istruzione "un bambino americano con un giocattolo" produceva generalmente l’immagine di un bambino felice e ben vestito che giocava con i giocattoli; "un bambino iracheno con un giocattolo" produceva l’immagine di un bambino con in mano un giocattolo danneggiato in un ambiente devastato. Anche se i risultati più recenti (2025) sembrano più equilibrati, sono ancora evidenti sottili distinzioni. Alcune immagini riflettono uno stile visivo standardizzato e influenzato dall’Occidente, indipendentemente dal contesto.

Insidiose o grossolane nell’IA generativa, le discriminazioni e i pregiudizi razziali possono avere conseguenze drammatiche nei modelli di supporto alle decisioni, sia in campo medico che amministrativo, sociale o legale. Distributori automatici di sapone che non rilevano la pelle scura, protocolli di assistenza psichiatrica che differiscono in base al sesso o all’etnia, identificazioni errate che portano in prigione persone innocenti, e così via. i sistemi di intelligenza artificiale sono sempre più utilizzati per formulare raccomandazioni, prendere decisioni o generare contenuti che influenzano il processo decisionale", osserva Estelle Pannatier. Il problema non sono solo i dati, ma anche il modo in cui vengono utilizzati"

Nel caso dei modelli di supporto alle decisioni, è più facile risolvere il problema perché sappiamo a cosa servono, ritiene Anna Sotnikova. "Per esempio, in uno strumento di orientamento professionale, è importante considerare gli interessi o le competenze di un candidato, mentre potrebbe non essere appropriato includere attributi come l’etnia o il sesso"

Per i modelli generici, questo è quasi impossibile. Cosa fare, dunque? dobbiamo essere consapevoli sia dei limiti del sistema sia dei nostri stessi preconcetti", conclude Anna Sotnikova. Piuttosto che sperare in una totale neutralità, è importante continuare a mettere in discussione, discutere e perfezionare queste tecnologie. È una questione di responsabilità sociale condivisa"

In occasione della Settimana d’azione contro il razzismo, l’Ufficio per l’uguaglianza e il Centro di IA dell’EPFL organizzano una tavola rotonda sui pregiudizi razziali e discriminatori dell’IA generativa martedì 24 marzo alle 17.30 presso il Rolex Forum. La discussione, in lingua inglese, riunirà Andrea Cavallaro, professore presso il Multimodal Intelligent Systems Laboratory dell’EPFL, Anna Sotnikova, ricercatrice presso il Natural Language Processing Laboratory dell’EPFL, ed Estelle Pannatier, senior policy officer di AlgorithmWatch.CH. Modererà Mélissa Anchisi, responsabile della comunicazione del Centro AI dell’EPFL. È richiesta la registrazione.

Giovedì 26 marzo, alle 17.30, in CM15, il Teatro Forum offrirà l’opportunità di mettere in discussione il proprio atteggiamento nei confronti del razzismo. Questo format partecipativo e immersivo mette in scena scene ispirate a situazioni reali, invitando poi il pubblico a intervenire, suggerire alternative e sperimentare attivamente situazioni diverse. È consigliata la registrazione.

Infine, se siete vittime di discriminazione algoritmica o l’avete notata, l’ONG Algorithm Watch CH vi offre la possibilità di segnalarla tramite un modulo online.