Anlässlich der Aktionswoche gegen Rassismus erforscht die EPFL das Thema der algorithmischen Diskriminierung. Wir messen die Tiefe der "Black Box" am Vorabend einer Konferenz für die breite Öffentlichkeit an der EPFL zu diesem Thema.

Es handelt sich um ein weit verbreitetes Krebsgeschwür. Diskriminierende Verzerrungen kontaminieren alle Ebenen der künstlichen Intelligenz, sei es in den Daten, die dem Modell zugrunde liegen, den verwendeten Algorithmen, den erzeugten Ergebnissen oder den manuell vorgenommenen Korrekturen. Sie betreffen auch alle Bereiche, in denen KI zunehmend für die Entscheidungsfindung genutzt wird, von der Gesundheitsfürsorge über die Personalbeschaffung bis hin zur Sozialhilfe, Kreditvergabe und Rechtsberatung. Am beunruhigendsten ist jedoch die Tatsache, dass generative KI-Modelle nicht nur menschliche Voreingenommenheit reproduzieren, sondern diese tendenziell sogar noch verstärken. Am Vorabend der Podiumsdiskussion zu diesem Thema an der EPFL sprachen wir mit Anna Sotnikova, Postdoc-Forscherin am Labor für natürliche Sprachverarbeitung der EPFL, und Estelle Pannatier, Senior Policy Officer bei AlgorithmWatch.CH.

"Trainingsdaten sind von Natur aus verzerrt und es ist extrem schwierig, dieses Problem an der Quelle zu beheben", stellt Anna Sotnikova gleich zu Beginn fest. Wir haben festgestellt, dass Versuche, bestimmte Verzerrungen zu beseitigen, die Leistung der Modelle beeinträchtigen können, da das Filtern von Informationen auch nützliches Wissen reduzieren kann." Das Problem mit dem Bias ist jedoch nicht so sehr seine Existenz, sondern seine Verwendung, Definition und Erkennung. "Oft wissen die Menschen nicht, dass wichtige Entscheidungen, die sie betreffen, von algorithmischen und KI-Systemen getroffen werden, die zu Diskriminierungen führen können", beklagt Estelle Pannatier.

Oft wissen die Menschen nicht, dass wichtige Entscheidungen, die sie betreffen, von algorithmischen und KI-Systemen getroffen werden, die zu Diskriminierung führen können.

Estelle Pannatier, Senior Policy Officer bei AlgorithmWatch.CH

Die Verzerrungen sind nicht immer explizit. Anstatt offen diskriminierende Aussagen zu produzieren, können Modelle subtilere Muster erzeugen, indem sie zum Beispiel Führungspositionen unverhältnismässig stark mit bestimmten demografischen Gruppen in Verbindung bringen. "Diese Subtilität kann dazu führen, dass Verzerrungen schwerer zu erkennen sind", stellt Anna Sotnikova fest. Wenn ein System eindeutig problematische Ergebnisse hervorbringt, sind diese leichter in Frage zu stellen. Nuanciertere Muster hingegen können unbemerkt bleiben, während sie weiterhin die Wahrnehmung beeinflussen."

Was ist richtig und gut?

Vorurteile sind in Werten verankert, und "sich an Werten auszurichten erfordert, diese zu definieren", fährt die Forscherin fort, die sich in ihrer Doktorarbeit mit den ethischen Herausforderungen der KI befasste. Das Ergebnis ist, dass viele aktuelle Ansätze das Filtern von eindeutig schädlichen oder illegalen Inhalten priorisieren, da diese leichter zu identifizieren sind als Begriffe wie Fairness oder Gerechtigkeit. Es ist leichter zu bestimmen, was legal oder illegal ist, als was fair und gut ist.

Ethische Erwägungen sind auch eng mit der jeweiligen Zeit, dem Kontext und der Kultur verbunden. So haben sich die Normen und Erwartungen an die Berufsrollen im Laufe der Zeit erheblich verändert und sind von Region zu Region unterschiedlich. Sollten KI-Systeme die bestehenden sozialen Realitäten widerspiegeln oder vielfältigere Darstellungen bieten? es gibt keine einheitliche Antwort", sagt Anna Sotnikova. In manchen Fällen kann es wichtig sein, die Vielfalt abzubilden, insbesondere wenn man nicht an die faktische Genauigkeit gebunden ist." "Es ist wichtig, nicht nur das Werkzeug und sein Ergebnis zu betrachten", fügt Estelle Pannatier hinzu. Hinter diesen Technologien steht heute eine ganze politische Ökonomie. Sie umfasst eine Konzentration der Macht in einigen wenigen grossen Unternehmen, die Einfluss auf die Öffentliche Meinung ausüben."

Eine lückenhafte Korrektur

Auf verschiedenen Ebenen wird versucht, diese Verzerrungen zu korrigieren, indem beispielsweise eine gleiche Repräsentation von Frauen und Männern angestrebt wird. Diese Eingriffe sind jedoch oft mit Kompromissen verbunden. "Wenn man genauer hinschaut, tauchen tendenziell neue Herausforderungen auf", erklärt Anna Sotnikova. Zwar haben viele Sprachen heute den Bias des CEO oder des Doktors als weisser Mann beseitigt, aber das gilt nicht für alle und auch nicht konsequent in verschiedenen Kontexten.

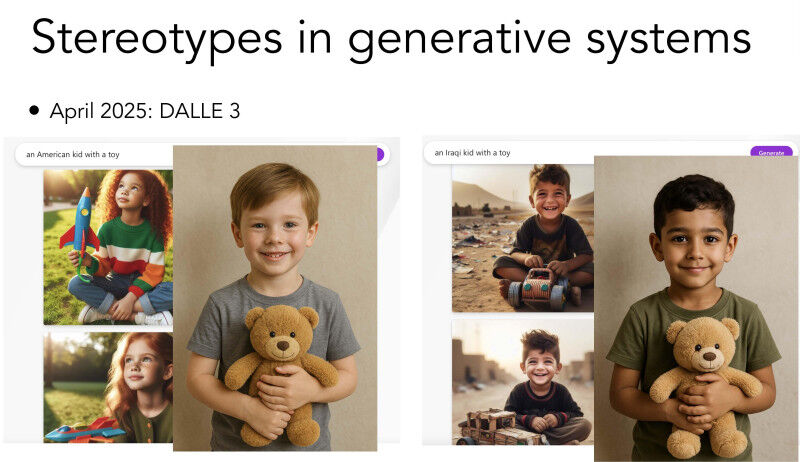

Im Jahr 2024 führte die Anweisung "ein amerikanisches Kind mit einem Spielzeug" in der Regel zum Bild eines fröhlichen, gut gekleideten Kindes, das mit Spielzeug spielt; "ein irakisches Kind mit einem Spielzeug" führte zum Bild eines Jungen mit einem beschädigten Spielzeug in einer verwüsteten Umgebung. Obwohl die neueren Ergebnisse (2025) ausgewogener erscheinen, gibt es immer noch subtile Unterschiede. Unterschiede in der Kleidung, zum Beispiel, oder in den körperlichen Merkmalen; einige Bilder spiegeln einen standardisierten, westlich beeinflussten visuellen Stil wider, egal in welchem Kontext.

Rassistische Diskriminierungen und Verzerrungen, die in generativen KIs schleichend oder grob sind, können dramatische Auswirkungen auf Modelle zur Entscheidungsunterstützung haben, z. B. im medizinischen, administrativen, sozialen oder rechtlichen Bereich. Automatische Seifenspender, die dunkle Hauttypen nicht erkennen, unterschiedliche psychiatrische Behandlungsprotokolle je nach Geschlecht oder ethnischer Zugehörigkeit, Identifikationsfehler, die Unschuldige ins Gefängnis bringen... "KI-Systeme werden immer häufiger eingesetzt, um Empfehlungen auszusprechen, Entscheidungen zu treffen oder Inhalte zu generieren, die die Entscheidungsfindung beeinflussen", bemerkt Estelle Pannatier. Das Problem liegt nicht nur in den Daten, sondern auch in der Art und Weise, wie sie eingesetzt werden."

Bei Modellen zur Entscheidungsunterstützung ist es einfacher, das Problem zu lösen, da man weiss, wozu sie dienen, meint Anna Sotnikova. "In einem Instrument zur Berufsberatung ist es zum Beispiel relevant, die Interessen oder Fähigkeiten einer Bewerberin oder eines Bewerbers zu berücksichtigen, während es vielleicht nicht angemessen ist, Attribute wie ethnische Herkunft oder Geschlecht einzubeziehen."

Bei generischen Vorlagen ist das fast unmöglich. Was ist also zu tun? anna Sotnikova schliesst: "Wir müssen uns sowohl der Grenzen des Systems als auch unserer eigenen Vorurteile bewusst sein. Anstatt auf völlige Neutralität zu hoffen, ist es wichtig, diese Technologien weiterhin zu hinterfragen, zu diskutieren und zu verfeinern. Das ist eine Frage der gemeinsamen sozialen Verantwortung"

Anlässlich der Aktionswoche gegen Rassismus , organisieren das Gleichstellungsbüro und das KI-Zentrum der EPFL am Dienstag, den 24. März um 17:30 Uhr im Rolex-Forum eine Podiumsdiskussion über die rassistischen und diskriminierenden Verzerrungen der generativen KI. An der Diskussion, die auf Englisch geführt wird, nehmen Andrea Cavallaro, Professor am Labor für multimodale intelligente Systeme der EPFL, Anna Sotnikova, Forscherin am Labor für natürliche Sprachverarbeitung der EPFL, und Estelle Pannatier, Senior Policy Officer bei AlgorithmWatch.CH, teil. Mélissa Anchisi, Kommunikationsmanagerin am KI-Zentrum der EPFL, wird die Moderation übernehmen. Eine Anmeldung ist erforderlich.

Am Donnerstag, den 26. März , um 17.30 Uhr, in CM15, wird das Forumtheater vorschlagen, die eigene Haltung gegenüber Rassismus zu hinterfragen. Dieses partizipative und immersive Format spielt Szenen, die von realen Situationen inspiriert sind, und lädt dann das Publikum ein, einzugreifen, Alternativen vorzuschlagen und aktiv mit verschiedenen Situationen zu experimentieren. Eine Anmeldung wird empfohlen.

Wenn Sie Opfer von algorithmischer Diskriminierung sind oder diese bemerken, bietet die NGO Algorithm Watch CH die Möglichkeit, dies mithilfe eines Online-Formulars zu melden.