Nell’era digitale, tutti noi lasciamo tracce digitali dietro di noi. I sistemi di messaggistica criptata end-to-end, come Signal e WhatsApp, sono un modo per garantire la riservatezza delle comunicazioni. Tuttavia, secondo i governi e le agenzie di sicurezza, questi sistemi di crittografia impediscono l’individuazione di attività criminali, come lo scambio di materiale pedopornografico, le attività terroristiche e il traffico di droga o di persone. I governi e le agenzie di sicurezza sostengono l’uso di una tecnologia di analisi lato client per rilevare i contenuti pedopornografici nelle comunicazioni crittografate end-to-end. Sostengono che questo processo non compromette la crittografia. Ana-Maria Cretu, ricercatrice presso il Security and Privacy Engineering Laboratory dell’EPFL - un laboratorio le cui competenze si collocano all’interfaccia tra apprendimento automatico, privacy e sicurezza - ha espresso le sue riserve sull’analisi lato client in occasione di una discussione organizzata dal Centre for Digital Trust (C4DT) dell’ EPFL.

In generale, la crittografia è come una lettera in una busta. Il documento non può essere letto mentre passa dal mittente al destinatario, e rompere la crittografia significa danneggiare la busta durante il trasporto. Con l’analisi lato client, la crittografia rimane intatta, ma non la riservatezza, poiché ciò equivale a leggere la lettera mentre viene scritta o dopo che la busta è stata aperta.

La crittografia end-to-end garantisce che solo i client a ciascuna estremità della catena di comunicazione, cioè il mittente e il destinatario, possano leggere il messaggio. "Più di due miliardi di persone in tutto il mondo utilizzano piattaforme dotate di crittografia end-to-end, come Signal e WhatsApp, e su quest’ultima si scambiano più di 100 miliardi di messaggi al giorno", spiega Ana-Maria Cretu.

Analisi lato client e fingerprinting delle immagini

L’analisi lato client comporta l’esame dei dati sul lato client della comunicazione, come la lettera o l’immagine che si vuole inviare o che si è ricevuta sullo smartphone. Nel caso della pedopornografia, questa tecnologia analizzerebbe le immagini e le confronterebbe con quelle presenti in un database di contenuti che presentano abusi su minori. Poiché è illegale possedere questo tipo di materiale, gli esperti di sicurezza informatica hanno sviluppato un modo per caratterizzare le immagini presenti nel database attraverso un processo chiamato "fingerprinting". "L’algoritmo di fingerprinting è progettato per preservare le caratteristiche principali dell’immagine in modo da poter effettuare confronti pertinenti, tenendo conto di semplici trasformazioni come il ridimensionamento, il ritaglio o la conversione in un altro formato", spiega Ana-Maria Cretu. Il confronto viene effettuato utilizzando le impronte digitali dell’immagine. Dal 2021 sono state esercitate pressioni per l’approvazione dell’Online Safety Act nel Regno Unito e di un regolamento per il controllo dei servizi di messaggistica nell’Unione Europea, che consente alle agenzie governative di obbligare le aziende a rilevare i contenuti illegali nelle loro comunicazioni.Riservatezza compromessa

Ana-Maria Cretu sostiene che, allo stato attuale, l’analisi lato client comporta troppi problemi, sia tecnici che etici, che ne rendono prematura l’implementazione. Questo approccio non solo vanifica lo scopo della crittografia, ma mette anche a rischio la riservatezza e introduce la minaccia di una sorveglianza di massa, che potrebbe mettere a repentaglio la democrazia moderna."Sebbene i materiali pedopornografici rappresentino un grave problema sociale, la lotta contro di essi richiede misure diverse dalla tecnologia", conclude Ana-Maria Cretu. Potremmo prevedere una collaborazione più stretta e intensa tra ricercatori e decisori politici, per contribuire a definire soluzioni efficaci e sufficientemente robuste che possano essere impiegate in totale sicurezza, pur continuando a preservare la riservatezza delle comunicazioni private."

Analisi fallaci

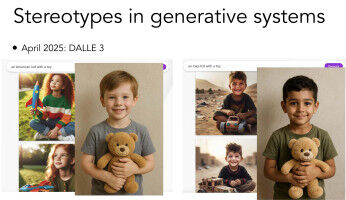

In primo luogo, i sistemi di rilevamento hanno margini di errore. In altre parole, potrebbero segnalare erroneamente alcuni contenuti. Si tratta di immagini che è lecito possedere e non di contenuti mirati", spiega Ana-Maria Cretu. Ma il sistema le identifica erroneamente come dannose. Potrebbero essere fotografie intime prodotte per consenso, immagini di bambini in spiaggia o condivise dai genitori con il pediatra. Se segnalate dal sistema, verrebbero condivise con le autorità, come le forze dell’ordine o il fornitore dei contenuti, per una verifica di persona. Questo potrebbe portare alla sospensione o al blocco degli account degli utenti. In una situazione del genere, le persone non vorrebbero rischiare di vedersi bloccare l’e-mail o la messaggistica. Ci sarebbe quindi un effetto deterrente. Il punto importante è che violeremmo la privacy di milioni di persone".Un sistema che può essere aggirato

Un altro problema dell’analisi lato client è che può essere aggirata, soprattutto quando si tratta di pornografia infantile", continua il ricercatore. I criminali cercheranno di nascondere le loro attività. Secondo la ricercatrice, "le prove che abbiamo suggeriscono che le soluzioni di analisi lato client non sarebbero efficaci nel rilevare contenuti pedopornografici in presenza di tali avversari. Potrebbero manipolare l’immagine applicando un filtro e sfuggire al rilevamento".Libertà di espressione a rischio

"Oggi l’obiettivo dell’analisi lato client è quello di rilevare le copie di materiale pedopornografico. Domani, nuovi tipi di contenuti potrebbero essere aggiunti all’elenco", aggiunge Ana-Maria Cretu. Di conseguenza, i governi potrebbero voler ampliare l’ambito di applicazione, ad esempio al terrorismo e ad altri tipi di attività criminali, ai discorsi dei dissidenti o ai contenuti LGBTQ+, a seconda del luogo in cui vengono attuate le misure. Una soluzione è quella di estendere il database. Ma chi lo controlla? Potremmo usare l’analisi lato client per trasformare i telefoni delle persone in strumenti di sorveglianza, e questo fa un po’ paura".Per saperne di più, leggete il Focus C4DT: "The Encryption Dilemma - Protecting privacy amid rising security concerns", scritto da Hector Garcia-Morales.