Che cos’è l’IA responsabile? Non è ancora stata formulata o adottata una definizione consensuale. L’AI Act dell’Unione Europea si limita attualmente a un elenco di sette principi per un’IA etica: intervento umano e supervisione; solidità tecnica e sicurezza; privacy e governance dei dati; trasparenza; diversità, non discriminazione ed equità; benessere sociale e ambientale; responsabilità.

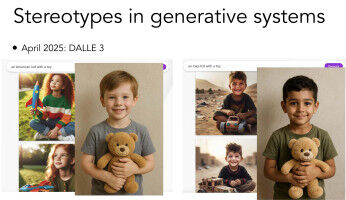

L’applicazione di questi principi è una sfida importante, soprattutto quando si tratta di pregiudizi, siano essi ideologici, politici, religiosi, sessisti, razzisti o più in generale cognitivi. "I pregiudizi non sono nuovi, gli esseri umani ne hanno molti", sottolinea Olivier Crochat, direttore del Center for Digital Trust dell’EPFL (C4DT). "L’IA generativa dovrebbe consentire di affrontare questo problema, sia per chi sviluppa gli algoritmi sia per gli utenti Un risultato distorto può servire come dati di addestramento per il modello e quindi esacerbare questa distorsione. I sistemi generativi di IA addestrati su dati distorti riproducono quindi le disuguaglianze esistenti. Che si tratti di decisioni di assunzione, mutui o riconoscimento facciale, i pregiudizi possono avere un impatto diretto sulla vita delle persone. Secondo la legge europea, un’IA generativa veramente responsabile deve quindi essere non solo trasparente e sicura, ma anche attivamente progettata per rilevare e correggere questi pregiudizi.

Uno dei timori è che gli algoritmi alimentati con fake news, cospirazioni, pregiudizi, propaganda o censura agiscano come cassa di risonanza, diventando un’arma di disinformazione di massa. olivier Crochat commenta: "L’algoritmo non farà peggio di quello che già esiste, ma se non verrà corretto, perpetuerà il problema e se verrà impiegato su larga scala, avrà conseguenze dannose" Un rapporto dell’Initiative for Media Innovation (IMI), con sede all’EPFL, è rassicurante a questo proposito. Ha esaminato le elezioni del 2024, anno in cui quasi metà dell’umanità è stata chiamata alle urne. Gli esperti hanno riscontrato che l’intelligenza artificiale non ha di fatto sconvolto i risultati delle votazioni. Il suo impatto è quindi rimasto limitato. Tuttavia, la proliferazione di contenuti manipolati, amplificati dagli algoritmi, ha contribuito alla frammentazione dell’opinione e alimentato un diffuso clima di sfiducia.

Il rapporto dell’IMI sottolinea che la manipolazione digitale a fini propagandistici non è nuova, ma l’IA generativa ne ha moltiplicato la capacità. "Ci troviamo di fronte a una corsa tra strumenti di creazione e strumenti di rilevamento", afferma Touradj Ebrahimi, professore specializzato in elaborazione dei segnali multimediali all’EPFL. Il suo laboratorio sviluppa strumenti per tracciare e rilevare contenuti sintetici. si tratta pur sempre di informatica e se sappiamo qual è il problema, possiamo trovare le soluzioni per risolverlo", aggiunge il direttore del C4DT. Inoltre, quando correggiamo un errore, questo scompare immediatamente per milioni di utenti"

La questione della responsabilità rimane comunque centrale. La maggior parte degli strumenti di IA generativa sono sviluppati e utilizzati da aziende private a scopo di lucro, che trasferiscono parte della responsabilità agli utenti. Ciò solleva questioni etiche e legali sulla rilevanza dei valori morali nella governance dell’IA.

A priori, l’algoritmo non farà peggio di ciò che già esiste, ma se non viene corretto, perpetuerà il problema, e se viene utilizzato su larga scala, avrà conseguenze dannose.

Olivier Crochat, direttore del Centro per la fiducia digitale (C4DT)

Una responsabilità condivisa

"Sebbene l’uso dell’IA sia in ultima analisi responsabilità degli utenti, è necessario istituire meccanismi di regolamentazione per prevenire abusi intenzionali o accidentali, come le serrature di sicurezza delle armi o i tappi di sicurezza dei farmaci", sottolinea Sabine Süsstrunk, docente presso il Laboratorio di immagine e rappresentazione visiva dell’EPFL e presidente del Consiglio svizzero della scienza. "Sono necessarie strategie collaudate come la certificazione, la regolamentazione e l’educazione per garantire prestazioni minime accettabili, chiarire le responsabilità e sensibilizzare il pubblico"Johan Rochel, docente di diritto ed etica dell’IA all’EPFL e co-direttore dell’ethix Lab for Innovation Ethics, spiega che la responsabilità non è distribuita in modo binario, ma deve essere vista come una distribuzione lungo l’intera catena del valore. Ogni decisione di progettazione del software comporta considerazioni etiche e compromessi, che devono essere anticipati molto prima che le loro conseguenze reali diventino evidenti.

Di più non è sempre meglio

Infine, un altro parametro cruciale è l’immensa quantità di dati utilizzati per addestrare i modelli di IA generativa. Molti database provengono dal settore privato, senza alcuna trasparenza sulla loro provenienza. Quando vengono interrogate sulla proprietà intellettuale o sulla rappresentatività dei dati, le principali aziende tecnologiche spesso respingono le preoccupazioni etiche, sostenendo che più dati sono meglio e quindi migliorano le prestazioni dell’IA.più dati non sono necessariamente migliori: ciò che conta sono dati migliori", insiste Johan Rochel. L’argomento della quantità non dovrebbe prevalere sulle considerazioni etiche" Sabine Süsstrunk aggiunge: "Se i dati sono protetti da copyright, devono essere concessi in licenza, acquistati o semplicemente non utilizzati. Purtroppo, poiché l’applicazione delle leggi sul copyright è contraddittoria a seconda della giurisdizione, la situazione attuale rimane altamente insoddisfacente."

Uso trasparente e responsabile

Come molte istituzioni, aziende e università, l’EPFL ha adottato dei principi per l’utilizzo dell’IA generativa. Pur riconoscendo l’enorme potenziale di questi strumenti, la Scuola ne sostiene l’utilizzo in modo informato, responsabile e trasparente.

"Informato" implica, in particolare, che l’utente sia consapevole dei limiti e dei rischi dello strumento e non vi sottoponga dati personali o riservati.

Un uso responsabile dell’IA generativa significa che gli utenti devono verificare l’accuratezza, l’obiettività, la qualità e la conformità al copyright dei contenuti che generano. In definitiva, sono sempre responsabili di questi contenuti. Gli utenti devono anche essere consapevoli dell’impatto energetico dell’utilizzo di questi strumenti.

Infine, trasparenza significa, ad esempio, dire alla persona o alle persone con cui si ha a che fare se un contenuto è stato generato dall’IA.

L’EPFL pubblica e aggiorna sul proprio sito web i principi per l’utilizzo dell’IA generativa, rivolti ai diversi pubblici.

01.

Come individuare i criminali su Signal o WhatsApp?

07.

Piccoli modelli linguistici di IA per una maggiore efficienza