Da quando OpenAI ha rilasciato il suo modello linguistico su larga scala alla fine del 2022, molte altre aziende "big tech" si sono lanciate nella corsa. A un ritmo che dimostra che non sono state colte di sorpresa e che il lavoro per creare strumenti di intelligenza artificiale generativa del linguaggio naturale era in realtà in fase di sviluppo da diversi anni, in parallelo.

Ciò che colpisce, tuttavia, è la somiglianza degli approcci. A parte alcune sfumature, tutti questi modelli si basano sullo stesso principio: l’ingestione e l’elaborazione da parte del deep learning di miliardi di "parametri", cioè di dati raccolti da documenti disponibili sulle reti.

Dopo questa fase, questi modelli sono in grado di generare contenuti - testi, immagini, suoni, video, ecc. - secondo principi puramente statistici. - secondo principi puramente statistici: le sequenze più probabili (di parole, pixel, suoni, ecc.) saranno prodotte in risposta all’istruzione. Ma il metodo ha i suoi rischi", spiega Nicolas Flammarion, responsabile del Laboratorio di teoria dell’apprendimento automatico dell’EPFL. Molti dei contenuti disponibili possono essere tossici, pericolosi o semplicemente fuorvianti. Il modello deve quindi passare attraverso una fase di supervisione e affinamento, ed essere sottoposto a una serie di filtri.

Evitare di annegare nelle informazioni

Ci troviamo quindi in una situazione sorprendente, in cui miliardi di byte di dati sono stati instancabilmente "macinati" in enormi centri di calcolo ad alto consumo energetico, ma solo una minima parte dei risultati può essere utilizzata. È un po’ come dover aprire uno per uno tutti i libri della Biblioteca del Congresso e sfogliarli pagina per pagina fino a trovare la frase giusta...Sembra quindi sensato trovare un modo per sfruttare le prestazioni estreme dei modelli linguistici di grandi dimensioni rendendoli al contempo più efficienti, sicuri ed economici. "Un modo per farlo è limitare le fonti dei modelli in modo che siano perfettamente operativi per applicazioni specifiche, senza pretendere di essere universali", spiega Martin Rajman, ricercatore e docente di intelligenza artificiale all’EPFL.

È qui che entrano in gioco i "piccoli modelli linguistici", o SLM. Possono essere snelliti in vari modi, ma il più delle volte l’obiettivo è quello di limitare le dimensioni del database a cui fanno riferimento: si tratta della cosiddetta "augmented retrieval generation", o ARG. Il caso di Meditron, riportato di seguito, è esemplare: le sue fonti sono database medici affidabili e validati.

Questo approccio esclude automaticamente qualsiasi propagazione di informazioni errate: il trucco consiste nell’applicare a questi dati controllati le competenze di un agente conversazionale addestrato su modelli di grandi dimensioni. Questo agente sarà in grado di leggere e collegare le informazioni per estrarre risorse utili.

L’EPFL sta esplorando diversi progetti che coinvolgono modelli linguistici di piccole dimensioni. Oltre a Meditron, è attualmente in corso un progetto pilota che copre tutte le leggi e i regolamenti che regolano la vita della Scuola - il corpus "Polylex". Un altro mira a ottimizzare la trascrizione dei corsi in modo che possano essere indicizzati nel modo più affidabile possibile. È allo studio anche l’adattamento di diversi processi amministrativi.

Un uso più economico

Limitando il volume delle fonti, questi modelli non richiedono più necessariamente potenti supercomputer: alcuni possono addirittura essere implementati in uno smartphone. Un altro grande vantaggio di queste applicazioni è che operano in modo isolato, proteggendo così i dati forniti attraverso le istruzioni", sottolinea Martin Rajman. Al contrario, se chiediamo a ChatGPT di trascrivere e poi riassumere una riunione, cosa che fa molto bene, non abbiamo idea di cosa verrà fatto con le informazioni potenzialmente riservate o relative alla protezione dei dati personali che vengono trasmesse a server sconosciuti".Basandosi sulla potenza conversazionale dei modelli di grandi dimensioni, ma limitandone molti dei pericoli, i modelli linguistici di piccole dimensioni sono quindi particolarmente ricercati dalle aziende. Sia per l’organizzazione interna che per i clienti, i robot conversazionali specifici possono rivelarsi estremamente utili ed efficaci. Non è quindi un caso che le aziende che offrono la possibilità di utilizzarli stiano sorgendo in tutto il mondo.

Se il 2023 è stato l’anno dei fuochi d’artificio dei modelli linguistici di grandi dimensioni, con i loro punti di forza e le loro debolezze, il 2025 potrebbe essere l’anno dell’adozione diffusa di questi modelli più piccoli, meglio calibrati e totalmente affidabili.

Meditron, il modello medico esemplare dell’EPFL

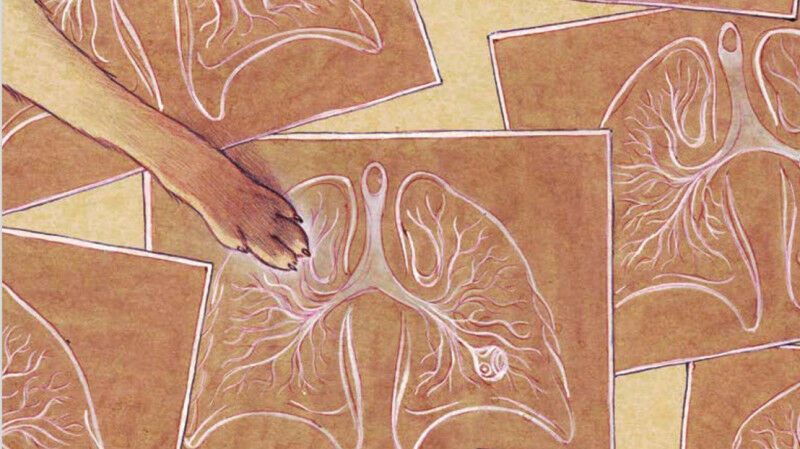

Quando si ha un’eruzione cutanea, un polpaccio dolorante o una prescrizione medica, ci si precipita su Internet per saperne di più. Che si tratti di una ricerca standard o di un’interrogazione a un’intelligenza artificiale generativa, cerchiamo di rassicurarci, anche a costo di perderci in un delirio ipocondriaco. Tuttavia, le diagnosi dei principali modelli linguistici generalisti, come ChatGPT o Claude, si basano su fonti oscure di ogni tipo, che li indeboliscono.La soluzione sta in modelli più piccoli, più mirati e più performanti, alimentati da dati più affidabili. Ad oggi, in campo medico, Meditron, l’algoritmo sviluppato dagli scienziati dell’EPFL e della Yale School of Medicine, si posiziona come lo strumento di diagnosi medica più efficace al mondo. Lanciato poco più di un anno fa come progetto open source, ha ottenuto risultati migliori della media umana negli esami medici negli Stati Uniti e fornisce risposte ragionevoli a una serie di domande. Anche se l’obiettivo di Meditron non è quello di sostituire il medico, ma di aiutarlo a prendere decisioni e a stabilire diagnosi, l’ultima parola deve sempre essere lasciata a un essere umano.

Il punto di forza di Meditron, che si basa sul modello open access Llama di Meta, è che è stato addestrato con fonti di dati medici accuratamente selezionate. Queste includono letteratura medica sottoposta a revisione paritaria da archivi ad accesso aperto come PubMed e un insieme unico di linee guida di pratica clinica, comprese quelle del CICR, che coprono molti paesi, regioni, ospedali e organizzazioni internazionali.

"L’accesso aperto è forse l’aspetto più importante di Meditron", afferma Annie Hartley, docente presso il Laboratory for Intelligent Technologies in Global Health and Humanitarian Response (LIGHT) dell’EPFL e di Yale. Scaricabile su un telefono cellulare, funziona in aree remote della civiltà dove l’accesso alla rete può essere scarso o nullo. Trasparente, a differenza delle scatole nere delle grandi aziende, Meditron migliora man mano che viene utilizzato. "È in costante sviluppo e il suo punto di forza è l’integrazione di dati provenienti da regioni spesso poco rappresentate", aggiunge Annie Hartley.

Per essere più universale e riflettere meglio le sfide del mondo reale, i progettisti hanno lanciato un’iniziativa che invita i professionisti di tutto il mondo a valutare le prestazioni del modello in scenari reali e ponendo domande difficili. "Il fatto che questi professionisti si offrano volontari all’interno della nostra comunità open source per convalidare in modo indipendente Meditron è un riconoscimento del suo valore", osserva il professore. "Nulla di tutto ciò è disponibile con i modelli chiusi sviluppati dalle grandi aziende tecnologiche", spiega Martin Jaggi, responsabile del Machine Learning and Optimisation Laboratory.

Un altro progetto dell’EPFL incentrato sulla qualità dei dati è quello di Emmanuel Abbé, cattedra di matematica della scienza dei dati all’EPFL, in collaborazione con il CHUV, per prevenire gli attacchi cardiaci. Grazie all’intelligenza artificiale, le immagini dell’angiografia - immagini del cuore e dei vasi sanguigni - vengono analizzate e confrontate con molte altre per prevedere il rischio di infarto. Per addestrare ulteriormente il loro modello, gli scienziati avvieranno un vasto studio di coorte in Svizzera che coinvolgerà almeno 1.000 pazienti nei prossimi tre anni.

Questi tipi di modelli potrebbero anche aprire le porte alla medicina personalizzata. Se incrociamo i risultati dei modelli con la cartella personale del paziente e con tutti i dati raccolti dagli orologi connessi o da alcune applicazioni, il potenziale è enorme", sostiene Olivier Crochat, direttore del Center for Digital Trust. Ma sarà necessario adottare misure solide per proteggere questi dati altamente sensibili e garantire che vengano utilizzati in modo etico ed equo".

Questo articolo è stato pubblicato nell’edizione di marzo 2025 della rivista Dimensions , che mette in luce l’eccellenza dell’EPFL attraverso approfondimenti, interviste, ritratti e notizie. Pubblicata 4 volte l’anno, in francese e in inglese, viene inviata ai membri degli Alumni contribuenti e a tutti coloro che desiderano abbonarsi. La rivista viene inoltre distribuita gratuitamente nei campus dell’EPFL.