Seit OpenAI Ende 2022 sein großes Sprachmodell in großem Stil veröffentlicht hat, sind viele andere Big-Tech-Unternehmen in das Rennen eingestiegen. In einem Tempo, das zeigt, dass sie alles andere als überrumpelt waren und dass die Arbeiten an generativen KI-Tools für natürliche Sprache eigentlich schon seit mehreren Jahren parallel in der Entwicklung waren.

Es ist jedoch auffällig, wie ähnlich sich die Ansätze sind. Abgesehen von einigen Nuancen beruhen alle Modelle auf demselben Prinzip: dem Prinzip, Milliarden von "Parametern", also Daten, die aus in Netzwerken verfügbaren Dokumenten gesammelt wurden, zu verschlingen und durch Deep Learning zu verarbeiten.

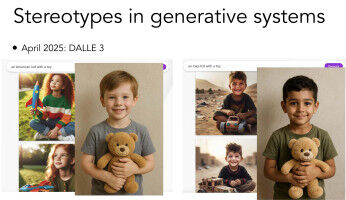

Danach sind diese Modelle in der Lage, Inhalte - Texte, Bilder, Töne, Videos usw. - zu generieren. - Nach rein statistischen Prinzipien werden die wahrscheinlichsten Sequenzen (von Wörtern, Pixeln, Tönen usw.) als Antwort auf die Anweisung produziert. Nicolas Flammarion, Leiter des Labors für maschinelle Lerntheorie an der EPFL, erklärt: "Diese Methode birgt jedoch Risiken. Ein großer Teil der zur Verfügung stehenden Inhalte kann giftig, gefährlich oder schlichtweg irreführend sein. Das Modell muss also eine Phase der Überwachung und Verfeinerung durchlaufen und sich zahlreiche Filter auferlegen lassen."

Vermeidung des Ertrinkens in Informationen

Wir befinden uns also in einer erstaunlichen Situation, in der Milliarden von Bytes an Daten unermüdlich in riesigen, energieintensiven Rechenzentren "gemahlen" wurden, von denen man aber nur einen winzigen Bruchteil der Ergebnisse nutzen kann. Es ist ein bisschen so, als müsste man bei jeder Suchanfrage alle Bücher der Kongressbuchhandlung einzeln öffnen und Seite für Seite durchblättern, bis man auf den richtigen Satz stößt...Einen Weg zu finden, die extreme Leistungsfähigkeit großer Sprachmodelle nutzen zu können und sie gleichzeitig effizienter, sicherer und sparsamer zu machen, scheint daher auf der Hand zu liegen. "Eine Methode, dies zu tun, besteht darin, die Quellen der Modelle so einzuschränken, dass sie für bestimmte Anwendungen perfekt funktionieren, ohne Anspruch auf Universalität zu erheben", erklärt Martin Rajman, Forscher und Lehrer für künstliche Intelligenz an der EPFL.

Hier kommen die sogenannten "kleinen Sprachmodelle", kurz SLM, ins Spiel. Sie können auf verschiedene Arten verschlankt werden, aber meistens geht es darum, die Größe der Datenbank, auf die sie sich beziehen, zu begrenzen - man spricht dann von "Augmented Generation Recovery", kurz RAG. Der Fall von Meditron ist beispielhaft: Seine Quellen sind zuverlässige und geprüfte medizinische Datenbanken.

Dies schließt die Verbreitung falscher Informationen von vornherein aus - der Trick besteht darin, diese kontrollierten Daten mit den Fähigkeiten eines an großen Modellen trainierten Gesprächsagenten zu bearbeiten. Dieser kann die Informationen lesen und verbinden, um daraus nützliche Ressourcen zu gewinnen.

Die EPFL erforscht mehrere Projekte für kleine Sprachmodelle. Neben Meditron läuft ein Pilotprojekt, das sich mit allen Gesetzen und Vorschriften befasst, die das Leben an der Hochschule regeln - das sogenannte "Polylex"-Korpus. Ein weiteres soll die Transkription von Vorlesungen optimieren, um sie möglichst zuverlässig indizieren zu können. Auch die Anpassung mehrerer Verwaltungsprozesse wird derzeit geprüft.

Kostengünstigere Nutzung

Durch die Begrenzung des Umfangs der Quellen benötigen diese Modelle nicht mehr unbedingt leistungsstarke Supercomputer - einige können sogar innerhalb eines Smartphones eingesetzt werden. "Ein weiterer wichtiger Vorteil dieser Anwendungen ist, dass sie in einem geschlossenen Raum arbeiten und daher die durch die Anweisungen gelieferten Daten schützen", betont Martin Rajman. Wenn man im Gegensatz dazu ChatGPT anweist, ein Meeting zu transkribieren und anschließend zusammenzufassen, was es sehr gut kann, hat man keine Ahnung, was mit den potenziell vertraulichen oder datenschutzrelevanten Informationen geschieht, die auf diese Weise an unbekannte Server übertragen werden."Da sie auf der Konversationsstärke der großen Modelle basieren, aber einen Großteil ihrer Gefahren einschränken, sind kleine Sprachmodelle daher besonders bei Unternehmen gefragt. Sowohl für die interne Organisation als auch für den Umgang mit Kunden können spezielle Chatbots äußerst nützlich und effektiv sein. Es ist also kein Zufall, dass es auf der ganzen Welt Unternehmen gibt, die den Einsatz von Robotern anbieten.

Wenn 2023 ein Feuerwerk an großen Sprachmodellen mit ihren Stärken und Schwächen gezündet wurde, könnte 2025 das Jahr sein, in dem diese kleineren, besser kalibrierten - und absolut vertrauenswürdigen - Modelle allgemein angenommen werden.

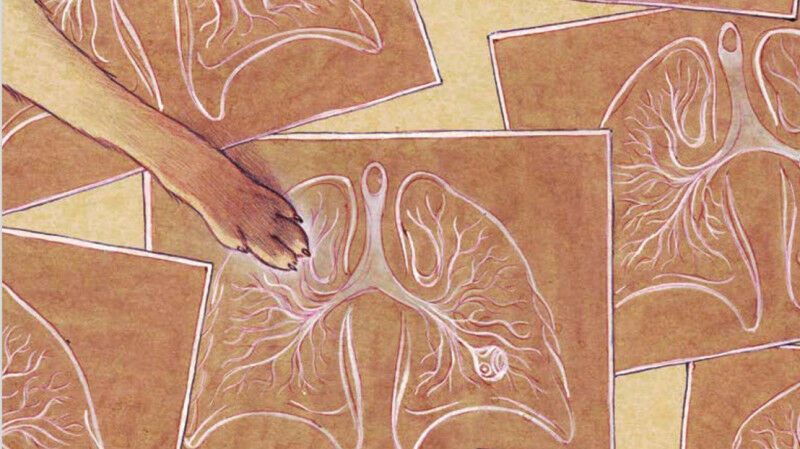

Meditron, das medizinische Vorzeigemodell der EPFL.

Wenn ein Hautausschlag oder Wadenschmerzen auftreten oder wenn ein Arzt ein Rezept ausstellt, stürzen wir uns auf das Internet, um mehr zu erfahren. Sei es durch eine klassische Suche oder eine Anfrage an eine generative KI, man versucht, sich zu beruhigen, auch auf die Gefahr hin, sich in einem hypochondrischen Delirium zu verlieren. Die Diagnosen der großen generalistischen Sprachmodelle wie ChatGPT oder Claude beruhen jedoch auf obskuren Quellen jeglicher Art, die sie schwächen.Die Lösung liegt in kleineren, gezielteren und leistungsfähigeren Modellen, die mit zuverlässigeren Daten gefüttert werden. Im medizinischen Bereich ist Meditron, ein von Wissenschaftlern der EPFL und der Yale School of Medicine entwickelter Algorithmus, bis heute das weltweit leistungsfähigste medizinische Diagnosewerkzeug. Er wurde vor etwas mehr als einem Jahr als Open Source veröffentlicht, schneidet bei medizinischen Prüfungen in den USA besser ab als der durchschnittliche Mensch und beantwortet viele Fragen auf vernünftige Weise. Meditron soll den Arzt nicht ersetzen, sondern ihm helfen, Entscheidungen zu treffen und Diagnosen zu stellen, wobei das letzte Wort immer ein Mensch haben sollte.

Die Stärke von Meditron, das auf dem Open-Access-Modell Llama von Meta aufbaut, liegt darin, dass es mit sorgfältig ausgewählten medizinischen Datenquellen trainiert wurde. Diese umfassen von Fachleuten begutachtete medizinische Literatur aus Open-Access-Repositorien wie PubMed und eine einzigartige Sammlung verschiedener Richtlinien für die klinische Praxis, darunter auch die des IKRK, die zahlreiche Länder, Regionen, Krankenhäuser und internationale Organisationen abdecken.

"Der freie Zugang ist vielleicht der wichtigste Aspekt von Meditron", meint Annie Hartley, Professorin am Labor für intelligente Technologien für globale Gesundheit und humanitäre Reaktionen (LIGHT) an der EPFL und in Yale. Es kann auf ein Mobiltelefon heruntergeladen werden und funktioniert auch in zivilisationsfernen Gebieten, in denen es vielleicht keinen oder nur einen eingeschränkten Netzzugang gibt. Meditron ist im Gegensatz zu den Black Boxes der Großunternehmen transparent und wird mit zunehmender Nutzung immer besser. "Es wird ständig weiterentwickelt, und seine Stärke ist es, Daten zu integrieren, die aus Regionen stammen, die oft unterrepräsentiert sind", fährt Annie Hartley fort.

Um universeller zu sein und die Herausforderungen der realen Welt besser widerzuspiegeln, haben die Designer und Designerinnen eine Initiative gestartet, die Fachleute aus aller Welt dazu auffordert, die Leistung des Modells in realen Szenarien und mit schwierigen Fragen zu bewerten. "Die Tatsache, dass sich diese Fachleute in unserer Open-Source-Gemeinschaft freiwillig melden, um Meditron unabhängig zu validieren, ist eine Anerkennung seines Wertes", stellt die Professorin fest. "Nichts davon ist mit den geschlossenen Modellen verfügbar, die von den großen Technologieunternehmen entwickelt werden", erläutert Martin Jaggi, Leiter des Labors für maschinelles Lernen und Optimierung.

Ein weiteres Projekt an der EPFL, das auf Datenqualität setzt, ist das von Emmanuel Abbé, Inhaber des Lehrstuhls für Mathematik der Datenwissenschaft an der EPFL, in Zusammenarbeit mit dem CHUV durchgeführte Projekt zur Vorbeugung von Herzinfarkten. Mithilfe einer KI werden die Bilder von Angiographien - bildgebende Verfahren zur Darstellung des Herzens und der Gefäße - analysiert und mit vielen anderen verglichen, um das Risiko eines Herzinfarkts vorherzusagen. Um ihr Modell besser zu trainieren, werden die Wissenschaftler in den nächsten drei Jahren eine große Kohortenstudie in der Schweiz mit mindestens 1000 Patienten starten.

Diese Art von Modellen könnte auch eine größere Tür für die personalisierte Medizin öffnen. "Wenn man die Ergebnisse der Modelle mit der persönlichen Patientenakte und allen Daten, die von vernetzten Uhren oder bestimmten Apps gesammelt werden, abgleicht, ist das Potenzial enorm", argumentiert Olivier Crochat, Direktor des Center for Digital Trust. Aber es wird darauf ankommen, robuste Maßnahmen zu ergreifen, um diese hochsensiblen Daten zu schützen und eine ethische und faire Nutzung zu gewährleisten."

Dieser Artikel wurde in der Ausgabe März 2025 des Magazins Dimensions veröffentlicht, das mit ausführlichen Dossiers, Interviews, Porträts und Nachrichten die Spitzenleistungen der EPFL hervorhebt. Das Magazin erscheint viermal jährlich auf Französisch und Englisch und wird an beitragende Alumni-Mitglieder sowie an alle Personen, die es abonnieren möchten, versandt. Das Magazin wird auch kostenlos auf dem Campus der EPFL verteilt.