A differenza delle strade a griglia di molte città americane, le strade europee sono spesso strette, tortuose e irregolari. Ci sono una moltitudine di incroci senza segnaletica chiara, zone pedonali, rotatorie e corsie condivise da auto, autobus, tram, motociclette e biciclette. La progettazione di un sistema di mobilità autonoma in grado di operare in sicurezza in queste condizioni non richiede solo sensori sofisticati e telecamere ad alte prestazioni.

Si tratta soprattutto di affrontare una sfida importante: capire come gli esseri umani si muovono nell’ambiente urbano. I pedoni, ad esempio, prendono spesso decisioni spontanee, come attraversare la strada bruscamente, cambiare improvvisamente direzione o muoversi tra la folla. I bambini possono correre dietro ai loro cani. Anche i ciclisti e gli scooter complicano la situazione con le loro manovre agili e talvolta imprevedibili.

"La mobilità autonoma, che si tratti di automobili o di robot per le consegne, deve andare oltre la semplice reazione al momento presente. Per navigare nel nostro mondo complesso e dinamico, questi sistemi devono essere in grado di immaginare, anticipare e simulare possibili futuri, proprio come gli esseri umani si chiedono cosa potrebbe accadere dopo. In breve, l’IA deve imparare ad anticipare il futuro", spiega Alexandre Alahi, direttore del VITA (Visual Intelligence for Transportation Laboratory) dell’EPFL

Spingendo indietro i limiti della previsione: GEM

Al laboratorio VITA, questo obiettivo sta diventando realtà. Quest’anno, il team ha visto accettate sette delle sue pubblicazioni di ricerca alla prestigiosa conferenza CVPR (Conference on Computer Vision and Pattern Recognition). Ciascun contributo propone un metodo innovativo per aiutare i sistemi di intelligenza artificiale a immaginare, prevedere e simulare possibili scenari futuri, dalla previsione dei movimenti umani alla generazione di sequenze video complete. Tutti i modelli e i set di dati sono pubblicati come open source, consentendo alla comunità di ricerca globale e all’industria di utilizzarli. Insieme, questi contributi rappresentano uno sforzo coordinato per consentire agli agenti autonomi non solo di reagire, ma di anticipare realmente il mondo che li circonda.Uno dei modelli più innovativi è stato progettato per prevedere sequenze video a partire da una singola immagine catturata da una telecamera di bordo (che offre un punto di vista in prima persona). Chiamato GEM (Generalizable Ego-Vision Multimodal World Model), aiuta i sistemi autonomi ad anticipare gli eventi futuri.

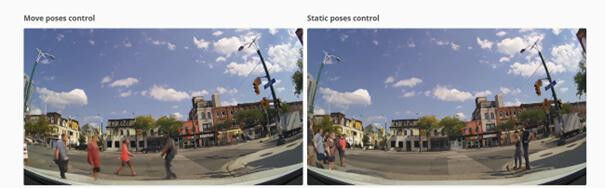

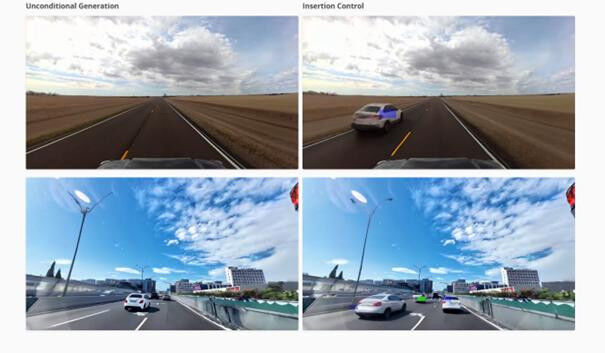

Nell’ambito della Swiss AI Initiative, lo strumento è stato addestrato su 4.000 ore di video che coprono la guida autonoma, le attività umane in prima persona e le riprese dei droni. In questo modo, GEM impara come si muovono le persone e gli oggetti in diversi ambienti. Utilizza queste conoscenze per generare nuove sequenze video che immaginano ciò che potrebbe accadere in seguito, sia che si tratti di un pedone che attraversa una strada o di un’auto che svolta a un incrocio. Questi scenari immaginati possono anche essere controllati aggiungendo auto e pedoni, rendendo GEM un potente strumento per l’addestramento e il test di sistemi autonomi in un’ampia varietà di situazioni realistiche.

Per fare le sue previsioni, il modello analizza simultaneamente diversi tipi di dati, noti come segnali multimodali. Utilizza le immagini RGB, cioè le immagini video a colori convenzionali, per comprendere il contesto visivo, e le mappe di profondità per comprendere la struttura 3D della scena. Questi due tipi di dati consentono al modello di comprendere sia il contesto visivo di una scena sia la profondità di campo. In altre parole, cosa sta accadendo e dove sta accadendo. GEM tiene conto anche dei movimenti della telecamera (ego-motion), delle posture umane e della dinamica degli oggetti nel tempo. Imparando come tutti questi segnali si evolvono insieme in migliaia di situazioni reali, è in grado di generare sequenze coerenti e realistiche che riflettono come una scena potrebbe cambiare nei secondi successivi.

"Lo strumento può essere utilizzato come simulatore realistico per veicoli, droni e altri robot, consentendo di testare in sicurezza le strategie di controllo in ambienti virtuali prima dell’impiego nel mondo reale. Può anche aiutare la pianificazione anticipando i cambiamenti nell’ambiente, migliorando così il processo decisionale contestuale", spiega Mariam Hassan, dottoranda del laboratorio VITA

Sulla strada della previsione

Il GEM si sta concentrando sulla generazione di video che prevedono il futuro e sull’esposizione dei sistemi autonomi a una varietà di scenari virtuali. Altri progetti di Alahi sono rivolti a livelli di astrazione inferiori per migliorare l’affidabilità, la generalizzazione e la consapevolezza sociale delle previsioni.

Questi sforzi formano un quadro di previsione più ampio che mappa le complesse interazioni in atto in ambienti urbani densi. Le sfide rimangono: mantenere la coerenza a lungo termine, raggiungere un’elevata precisione spaziale e garantire l’efficienza computazionale. Al centro di tutto questo, rimane una domanda cruciale: fino a che punto possiamo prevedere il comportamento di individui che non seguono sempre schemi prevedibili? Le decisioni umane sono influenzate dall’intenzione, dalle emozioni e dal contesto, fattori che le macchine non sempre percepiscono

L’Iniziativa AI Svizzera

Lanciata nel dicembre 2023 dall’EPFL e dal Politecnico di Zurigo, la Swiss AI Initiative riunisce più di 10 istituzioni accademiche svizzere. Con oltre 800 ricercatori coinvolti e l’accesso a 10 milioni di ore di GPU, è il più grande sforzo open source al mondo dedicato ai modelli fondamentali di IA. Il modello sviluppato dal laboratorio VITA, in collaborazione con altre quattro istituzioni (Università di Berna, SDSC, Università di Zurigo e ETH di Zurigo), è uno dei primi modelli su larga scala a emergere da questa ambiziosa iniziativa. È stato addestrato sul supercomputer Alps del Centro nazionale svizzero di supercalcolo (CSCS), che fornisce la potenza di calcolo necessaria per elaborare immensi volumi di dati multimodaliE la mobilità autonoma in Svizzera?

In Svizzera, la mobilità completamente autonoma non è ancora consentita sulle strade pubbliche. Tuttavia, dal marzo 2025, le auto dotate di sistemi avanzati di assistenza alla guida sono autorizzate a guidare, accelerare e frenare autonomamente. I conducenti devono comunque rimanere vigili e pronti a riprendere il controllo. Questo segna un passo importante verso l’automazione nella vita quotidiana. I cantoni possono approvare percorsi specifici per i veicoli completamente autonomi, che operano senza la presenza umana a bordo e sono monitorati a distanza da centri di controllo. Questi percorsi saranno utilizzati principalmente da autobus e veicoli per le consegneRiferimenti

"MotionMap: Representing Multimodality in Human Pose Forecasting", R. Hosseininejad, M. Shukla, S. Saadatnejad, M. Salzmann, A. Alahi, CVPR’25. Codice"Helvipad: A Real-World Dataset for Omnidirectional Stereo Depth Estimation", M. Zayene, J. Endres, A. Havolli, C.Corbière, S. Cherkaoui, A. Ben Ahmed Kontouli, A. Alahi, CVPR’25. Codice

"FG2: localizzazione cross-view a grana fine tramite corrispondenza di caratteristiche a grana fine". Z. Xia, A. Alahi, CVPR’25. Codice

"Towards Generalizable Trajectory Prediction Using Dual-Level Representation Learning And Adaptive Prompting", K. Messaoud, M. Cord, A. Alahi, CVPR’25. Codice

Sim-to-Real Causal Transfer: A Metric Learning Approach to Causally-Aware Interaction Representations", A. Rahimi, P-C. Luan, Y. Liu, F. Rajic, A. Alahi, CVPR’25. Codice

"Previsione certificata di traiettorie umane", M. Bahari, S. Saadatnejad, A. Askari Farsangi, S. Moosavi-Dezfooli, A. Alahi, CVPR’25 Codice

"GEM: A Generalizable Ego-Vision Multimodal World Model for Fine-Grained Ego-Motion, Object Dynamics, and Scene Composition Control", M. Hassan*, S. Stapf*, A. Rahimi*, P. M. B. Rezende*, Y. Haghighi, D. Brüggemann, I. Katircioglu, L. Zhang, X. Chen, S. Saha,M. Cannici, E. Aljalbout, B. Ye, X. Wang, A. Davtyan, M. Salzmann, D. Scaramuzza, M. Pollefeys, P. Favaro, A. Alahi, CVPR’25. Codice