Im Gegensatz zu den karierten Strassen vieler amerikanischer Städte sind die Strassen in Europa oft eng, kurvig und unregelmässig. Es gibt unzählige Kreuzungen ohne klare Markierungen, Fussgängerzonen, Kreisverkehre und Fahrbahnen, die von Autos, Bussen, Strassenbahnen, Motorrädern oder Fahrrädern gemeinsam genutzt werden. Die Entwicklung eines autonomen Mobilitätssystems, das unter diesen Bedingungen sicher funktionieren kann, erfordert mehr als nur hochentwickelte Sensoren und leistungsfähige Kameras.

Es geht vor allem darum, zu verstehen, wie sich Menschen in der städtischen Umgebung bewegen. Fussgänger zum Beispiel treffen oft spontane Entscheidungen, wie das plötzliche Überqueren der Strasse, einen plötzlichen Richtungswechsel oder das Durchdrängen einer Menschenmenge. Ein Kind rennt vielleicht seinem Hund hinterher. Auch Fahrrad- und Rollerfahrer erschweren die Situation durch ihre wendigen und manchmal unvorhersehbaren Manöver.

"Autonome Mobilität, ob in Form von Autos oder Lieferrobotern, muss mehr sein als nur eine Reaktion auf den Moment. Um in unserer komplexen und dynamischen Welt navigieren zu können, müssen diese Systeme in der Lage sein, sich mögliche Zukünfte vorzustellen, zu antizipieren und zu simulieren - so wie Menschen sich fragen, was als Nächstes passieren könnte. Kurz gesagt, die KI muss lernen, die Zukunft zu antizipieren", erklärt Alexandre Alahi, Leiter des VITA-Labors (Visual Intelligence for Transportation Laboratory) an der EPFL

Die Grenzen der Vorhersage überschreiten: GEM

Im VITA-Labor wird dieses Ziel in die Tat umgesetzt. In diesem Jahr wurden sieben Forschungspublikationen des Teams auf der renommierten Konferenz CVPR (Conference on Computer Vision and Pattern Recognition) angenommen. Jeder der Beiträge bietet eine innovative Methode, um KI-Systemen dabei zu helfen, sich mögliche Zukunftsszenarien vorzustellen, vorherzusagen und zu simulieren - von der Vorhersage menschlicher Bewegungen bis hin zur Generierung kompletter Videosequenzen. Alle Modelle und Datensätze werden als Open Source veröffentlicht, sodass sie von der weltweiten Forschungsgemeinschaft und der Industrie genutzt werden können. Zusammen stellen diese Beiträge eine koordinierte Anstrengung dar, die es autonomen Agenten ermöglicht, nicht nur zu reagieren, sondern die Welt um sie herum wirklich zu antizipieren.Eines der innovativsten Modelle wurde entwickelt, um Videosequenzen aus einem einzigen Bild einer Bordkamera (aus der Ich-Perspektive) vorherzusagen. Es trägt den Namen GEM (Generalizable Ego-Vision Multimodal World Model) und hilft autonomen Systemen, zukünftige Ereignisse vorauszusehen.

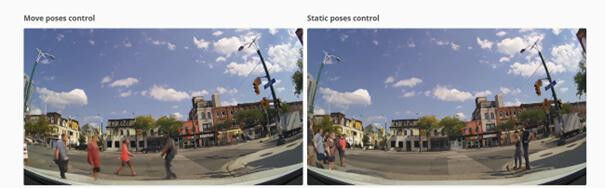

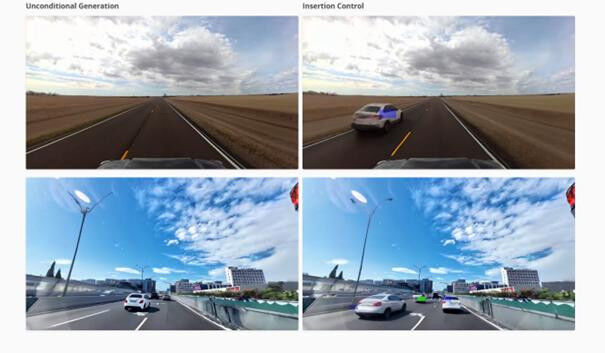

Im Rahmen der Swiss AI Initiative wurde das Tool mit 4000 Stunden Videomaterial trainiert, das autonomes Fahren, menschliche Aktivitäten aus der Ich-Perspektive und Drohnenaufnahmen abdeckt. Auf diese Weise lernt GEM, wie sich Menschen und Objekte in verschiedenen Umgebungen bewegen. Es nutzt dieses Wissen, um neue Videosequenzen zu generieren, die sich vorstellen, was als Nächstes passieren könnte - sei es ein Fussgänger, der über ein Rad läuft, oder ein Auto, das an einer Kreuzung abbiegt. Diese vorgestellten Szenarien können sogar durch Hinzufügen von Autos und Fussgängern gesteuert werden, was GEM zu einem mächtigen Werkzeug macht, um autonome Systeme in einer Vielzahl von realistischen Situationen zu trainieren und zu testen.

Um seine Vorhersagen zu treffen, analysiert das Modell gleichzeitig mehrere Arten von Daten, die sogenannten multimodalen Signale. Es nutzt RGB-Bilder - also herkömmliche Farbvideobilder -, um den visuellen Kontext zu verstehen, und Tiefenkarten, um die 3D-Struktur der Szene zu erfassen. Diese beiden Datentypen ermöglichen es dem Modell, sowohl den visuellen Kontext einer Szene als auch die Tiefenschärfe zu verstehen. Mit anderen Worten: was passiert und wo es passiert. GEM berücksichtigt auch Kamerabewegungen (Ego-Motion), menschliche Körperhaltungen und die Dynamik von Objekten im Laufe der Zeit. Indem es lernt, wie sich all diese Signale in Tausenden von realen Situationen zusammen entwickeln, kann es kohärente und realistische Sequenzen erzeugen, die die möglichen Veränderungen einer Szene in den kommenden Sekunden widerspiegeln.

"Das Tool kann als realistischer Simulator für Fahrzeuge, Drohnen und andere Roboter dienen, mit dem Kontrollstrategien in virtuellen Umgebungen sicher getestet werden können, bevor sie in der realen Welt eingesetzt werden. Es kann auch bei der Planung helfen, indem es Veränderungen in der Umgebung voraussieht und so die kontextbezogene Entscheidungsfindung stärkt", erklärt Mariam Hassan, Doktorandin am VITA-Labor

Auf dem Weg zur Vorhersage

GEM konzentriert sich auf die Generierung von Videos, die die Zukunft vorhersagen, und darauf, autonome Systeme verschiedenen virtuellen Szenarien auszusetzen. Andere Projekte von Alahi zielen auf niedrigere Abstraktionsebenen ab, um die Zuverlässigkeit, Verallgemeinerbarkeit und das soziale Bewusstsein von Vorhersagen zu verbessern.

Diese Bemühungen bilden einen breiteren Vorhersagerahmen, der die komplexen Interaktionen in dichten städtischen Umgebungen abbildet. Die Herausforderungen bleiben zahlreich: langfristige Kohärenz, hohe räumliche Genauigkeit und Computereffizienz. Im Zentrum all dessen steht eine entscheidende Frage: Wie weit lässt sich das Verhalten von Menschen vorhersagen, die nicht immer vorhersehbaren Mustern folgen? Menschliche Entscheidungen werden von Absicht, Emotion und Kontext geprägt - Faktoren, die Maschinen nicht immer wahrnehmen können

Über die Swiss AI Initiative

Die Swiss AI Initiative, die im Dezember 2023 von der EPFL und der ETH Zürich ins Leben gerufen wurde, vereint mehr als 10 Schweizer akademische Institutionen. Mit über 800 beteiligten Forschern und Forscherinnen und dem Zugang zu 10 Millionen GPU-Stunden ist sie die weltweit grösste Open-Source-Anstrengung, die sich grundlegenden KI-Modellen widmet. Das vom VITA-Labor in Zusammenarbeit mit vier anderen Institutionen (Universität Bern, SDSC, Universität Zürich und ETH Zürich) entwickelte Modell ist eines der ersten grossen Modelle, die aus dieser ehrgeizigen Initiative hervorgegangen sind. Es wurde auf dem Supercomputer Alps des Swiss National Supercomputing Centre (CSCS) trainiert, der die nötige Rechenleistung für die Verarbeitung riesiger Mengen multimodaler Daten bereitstelltWie steht es mit der autonomen Mobilität in der Schweiz?

In der Schweiz ist die vollständig autonome Mobilität auf Öffentlichen Strassen noch nicht erlaubt. Seit März 2025 dürfen Autos, die mit fortschrittlichen Fahrerassistenzsystemen ausgestattet sind, jedoch autonom fahren, beschleunigen und bremsen. Die Fahrer müssen jedoch wachsam bleiben und bereit sein, die Kontrolle wieder zu übernehmen. Dies ist ein wichtiger Schritt hin zur Automatisierung des Alltags. Die Kantone können spezielle Strecken für vollständig autonome Fahrzeuge genehmigen, die ohne menschliche Präsenz an Bord funktionieren und von Kontrollzentren fernüberwacht werden. Diese Strecken werden hauptsächlich von Bussen und Lieferfahrzeugen genutzt werdenReferenzen

"MotionMap: Representing Multimodality in Human Pose Forecasting", R. Hosseininejad, M. Shukla, S. Saadatnejad, M. Salzmann, A. Alahi, CVPR’25. Code"Helvipad: A Real-World Dataset for Omnidirectional Stereo Depth Estimation", M. Zayene, J. Endres, A. Havolli, C.Corbière, S. Cherkaoui, A. Ben Ahmed Kontouli, A. Alahi, CVPR’25. Code

"FG2: Fine-Grained Cross-View Localization by Fine-Grained Feature Matching". Z. Xia, A. Alahi, CVPR’25. Code

"Towards Generalizable Trajectory Prediction Using Dual-Level Representation Learning And Adaptive Prompting", K. Messaoud, M. Cord, A. Alahi, CVPR’25. Code

Sim-to-Real Causal Transfer: A Metric Learning Approach to Causally-Aware Interaction Representations", A. Rahimi, P-C. Luan, Y. Liu, F. Rajic, A. Alahi, CVPR’25. Code

"Certified human trajectory prediction", M. Bahari, S. Saadatnejad, A. Askari Farsangi, S. Moosavi-Dezfooli, A. Alahi, CVPR’25 Code

"GEM: A Generalizable Ego-Vision Multimodal World Model for Fine-Grained Ego-Motion, Object Dynamics, and Scene Composition Control", M. Hassan*, S. Stapf*, A. Rahimi*, P. M. B. Rezende*, Y. Haghighi, D. Brüggemann, I. Katircioglu, L. Zhang, X. Chen, S. Saha,M. Cannici, E. Aljalbout, B. Ye, X. Wang, A. Davtyan, M. Salzmann, D. Scaramuzza, M. Pollefeys, P. Favaro, A. Alahi, CVPR’25. Code